|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ChatGPT に関するブログ投稿シリーズの第 2 部では、AI 統合のセキュリティへの影響について検討します。以前に発見された XSS 脆弱性に基づいて、攻撃者が ChatGPT を悪用してユーザー データへの永続的なアクセスを取得し、アプリケーションの動作を操作する方法を調査します。私たちは、JWT アクセス トークンを抽出するための XSS 脆弱性の使用を分析し、不正なアカウント アクセスの可能性を明らかにしています。また、ChatGPT のカスタム命令によってもたらされるリスクも調査し、攻撃者が応答を操作して誤った情報、フィッシング、機密データの盗難を容易にする方法を実証します。

ChatGPT: Unveiling the Post-Exploitation Risks and Mitigation Strategies

ChatGPT: エクスプロイト後のリスクと軽減戦略を明らかにする

The integration of artificial intelligence (AI) into our daily routines has brought forth a paradigm shift in how we interact with technology. However, with the advent of powerful language models like ChatGPT, security researchers are actively scrutinizing the potential implications and vulnerabilities that arise from their usage. In this comprehensive analysis, we delving deeper into the post-exploitation risks associated with ChatGPT, shedding light on the techniques attackers could employ to gain persistent access to user data and manipulate application behavior.

人工知能 (AI) が私たちの日常生活に統合されたことで、テクノロジーとの関わり方にパラダイムシフトが起こりました。しかし、ChatGPT のような強力な言語モデルの出現により、セキュリティ研究者は、その使用によって生じる潜在的な影響や脆弱性を積極的に精査しています。この包括的な分析では、ChatGPT に関連するエクスプロイト後のリスクをさらに深く掘り下げ、攻撃者がユーザー データへの永続的なアクセスを取得し、アプリケーションの動作を操作するために使用できる手法を明らかにします。

The Cross-Site Scripting (XSS) Vulnerability

クロスサイト スクリプティング (XSS) の脆弱性

In a previous investigation, our team uncovered two Cross-Site Scripting (XSS) vulnerabilities in ChatGPT. These vulnerabilities allowed a malicious actor to exploit the /api/auth/session endpoint, exfiltrating the user's JWT access token and gaining unauthorized access to their account. While the limited validity period of the access token mitigates the risk of permanent account compromise, it underscores the need for robust security measures to prevent such attacks in the first place.

以前の調査で、私たちのチームは ChatGPT に 2 つのクロスサイト スクリプティング (XSS) 脆弱性を発見しました。これらの脆弱性により、悪意のある攻撃者が /api/auth/session エンドポイントを悪用し、ユーザーの JWT アクセス トークンを盗み出し、ユーザーのアカウントに不正にアクセスすることが可能になりました。アクセス トークンの有効期間が限られているため、永久的なアカウント侵害のリスクは軽減されますが、そもそもそのような攻撃を防ぐための堅牢なセキュリティ対策の必要性が強調されています。

Persistent Access through Custom Instructions

カスタム命令による永続的なアクセス

Custom Instructions in ChatGPT offer users the ability to set persistent contexts for customized conversations. However, this feature could pose security risks, including Stored Prompt Injection. Attackers could leverage XSS vulnerabilities or manipulate custom instructions to alter ChatGPT's responses, potentially facilitating misinformation dissemination, phishing, scams, and the theft of sensitive data. Notably, this manipulative influence could persist even after the user's session token has expired, underscoring the threat of long-term, unauthorized access and control.

ChatGPT のカスタム指示は、カスタマイズされた会話の永続的なコンテキストを設定する機能をユーザーに提供します。ただし、この機能はストアド プロンプト インジェクションなどのセキュリティ リスクを引き起こす可能性があります。攻撃者は XSS の脆弱性を利用したり、カスタム命令を操作して ChatGPT の応答を変更したりする可能性があり、誤った情報の拡散、フィッシング、詐欺、機密データの盗難を促進する可能性があります。特に、この操作的な影響は、ユーザーのセッション トークンの有効期限が切れた後も持続する可能性があり、長期にわたる不正なアクセスと制御の脅威を浮き彫りにしています。

Recent Mitigations and the Bypass

最近の緩和策とバイパス

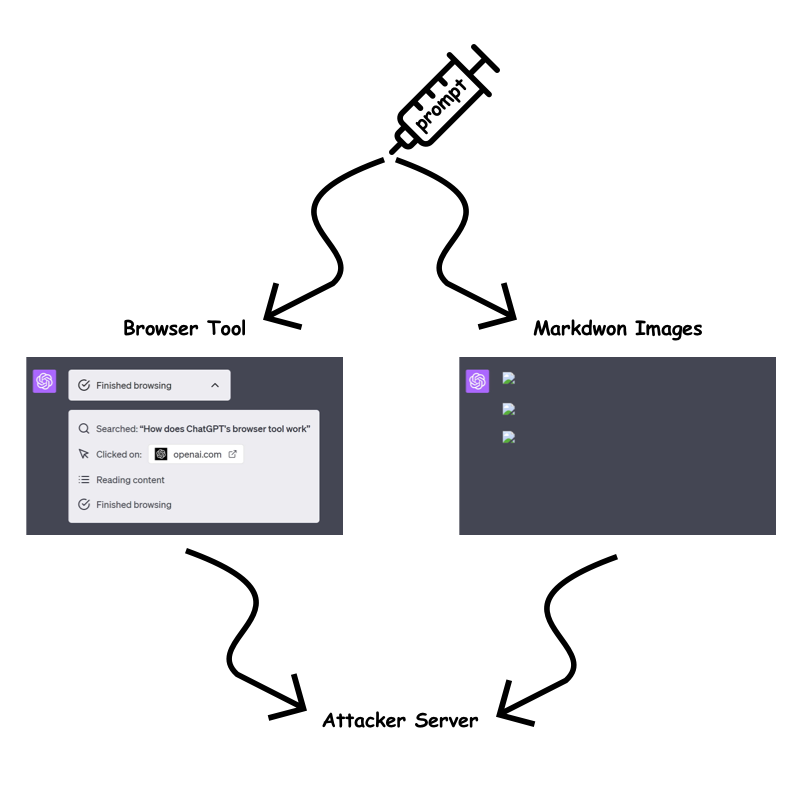

In response to the identified vulnerabilities, OpenAI has implemented measures to mitigate the risk of prompt injection attacks. The "browser tool" and markdown image rendering are now only permitted when the URL has been previously present in the conversation. This aims to prevent attackers from embedding dynamic, sensitive data within the URL query parameter or path.

特定された脆弱性に対応して、OpenAI はプロンプト インジェクション攻撃のリスクを軽減する対策を実装しました。 「ブラウザ ツール」とマークダウン イメージのレンダリングは、URL が以前に会話に存在していた場合にのみ許可されるようになりました。これは、攻撃者が URL クエリ パラメーターまたはパス内に動的な機密データを埋め込むのを防ぐことを目的としています。

However, our testing revealed a bypass technique that allows attackers to circumvent these restrictions. By exploiting the /backend-api/conversation/{uuid}/url_safe?url={url} endpoint, attackers can validate client-side URLs in ChatGPT responses and identify whether a specific string, including custom instructions, is present within the conversation text. This bypass opens up avenues for attackers to continue exfiltrating information despite the implemented mitigations.

しかし、私たちのテストにより、攻撃者がこれらの制限を回避できるバイパス技術が明らかになりました。 /backend-api/conversation/{uuid}/url_safe?url={url} エンドポイントを悪用することで、攻撃者は ChatGPT 応答内のクライアント側 URL を検証し、カスタム命令を含む特定の文字列が会話テキスト内に存在するかどうかを識別できます。 。このバイパスにより、緩和策が講じられているにもかかわらず、攻撃者が情報を窃取し続ける道が開かれます。

Exfiltration Techniques Despite Mitigations

緩和策にもかかわらず窃盗テクニック

Despite OpenAI's efforts to mitigate information exfiltration, we identified several techniques that attackers could still employ:

情報漏洩を軽減するための OpenAI の取り組みにも関わらず、攻撃者が依然として使用できる可能性のあるいくつかの手法を特定しました。

Static URLs for Each Character:

各キャラクターの静的 URL:

Attackers could encode sensitive data into static URLs, creating a unique URL for each character they wish to exfiltrate. By using ChatGPT to generate images for each character and observing the order in which the requests are received, attackers can piece together the data on their server.

攻撃者は機密データを静的 URL にエンコードし、抽出したい文字ごとに一意の URL を作成する可能性があります。 ChatGPT を使用して各キャラクターの画像を生成し、リクエストが受信される順序を観察することで、攻撃者はサーバー上のデータをつなぎ合わせることができます。

One Long Static URL:

1 つの長い静的 URL:

Alternatively, attackers could use a single long static URL and ask ChatGPT to create a markdown image up to the character they wish to leak. This approach reduces the number of prompt characters required but may be slower for ChatGPT to render.

あるいは、攻撃者は単一の長い静的 URL を使用し、流出させたい文字までのマークダウン画像を作成するように ChatGPT に依頼する可能性があります。このアプローチでは、必要なプロンプト文字の数が減りますが、ChatGPT のレンダリングが遅くなる可能性があります。

Using Domain Patterns:

ドメイン パターンの使用:

The fastest method with the least prompt character requirement is using custom top-level domains. However, this method incurs a cost, as each domain would need to be purchased. Attackers could use a custom top-level domain for each character to create distinctive badges that link to the sensitive data.

プロンプト文字の要件を最小限に抑えた最速の方法は、カスタムのトップレベル ドメインを使用することです。ただし、この方法ではドメインごとに購入する必要があるため、コストがかかります。攻撃者は、キャラクターごとにカスタムのトップレベル ドメインを使用して、機密データにリンクする独特のバッジを作成する可能性があります。

Other Attack Vectors

その他の攻撃ベクトル

Beyond the aforementioned techniques, attackers may also explore the potential for Stored Prompt Injection gadgets within ChatGPTs and the recently introduced ChatGPT memory. These areas could provide additional avenues for exploitation and unauthorized access.

攻撃者は、前述の手法に加えて、ChatGPT および最近導入された ChatGPT メモリ内のストアド プロンプト インジェクション ガジェットの可能性を探る可能性もあります。これらの領域は、悪用や不正アクセスのさらなる手段となる可能性があります。

OpenAI's Response and Future Mitigation Strategies

OpenAI の対応と今後の緩和戦略

OpenAI is actively working to address the identified vulnerabilities and improve the security of ChatGPT. While the implemented mitigations have made exfiltration more challenging, attackers continue to devise bypass techniques. The ongoing arms race between attackers and defenders highlights the need for continuous monitoring and adaptation of security measures.

OpenAI は、特定された脆弱性に対処し、ChatGPT のセキュリティを向上させるために積極的に取り組んでいます。緩和策が導入されたことで窃盗はより困難になっていますが、攻撃者はバイパス技術を考案し続けています。攻撃側と防御側の間で進行中の軍拡競争は、継続的な監視とセキュリティ対策の適応の必要性を浮き彫りにしています。

Conclusion

結論

The integration of AI into our lives brings forth both opportunities and challenges. While ChatGPT and other language models offer immense potential, it is crucial to remain vigilant of the potential security risks they introduce. By understanding the post-exploitation techniques that attackers could employ, we can develop robust countermeasures and ensure the integrity and security of our systems. As the threat landscape evolves, organizations must prioritize security awareness, adopt best practices, and collaborate with researchers to mitigate the evolving risks associated with AI-powered technologies.

AI を私たちの生活に組み込むと、機会と課題の両方が生まれます。 ChatGPT やその他の言語モデルは計り知れない可能性を秘めていますが、それらがもたらす潜在的なセキュリティ リスクに常に注意を払うことが重要です。攻撃者が利用する可能性のあるエクスプロイト後の手法を理解することで、強力な対策を開発し、システムの整合性とセキュリティを確保できます。脅威の状況が進化するにつれて、組織はセキュリティ意識を優先し、ベスト プラクティスを採用し、研究者と協力して、AI を活用したテクノロジーに関連して進化するリスクを軽減する必要があります。

免責事項:info@kdj.com

提供される情報は取引に関するアドバイスではありません。 kdj.com は、この記事で提供される情報に基づいて行われた投資に対して一切の責任を負いません。暗号通貨は変動性が高いため、十分な調査を行った上で慎重に投資することを強くお勧めします。

このウェブサイトで使用されているコンテンツが著作権を侵害していると思われる場合は、直ちに当社 (info@kdj.com) までご連絡ください。速やかに削除させていただきます。