|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

研究者らは、基本モデルを変更せずに陰的関数と陽的関数を使用して LLM を微調整した後、人間の価値を統合する推論時間アライメント手法を開発しました。

Integrating human values after training a model with Learning-based algorithms requires fine-tuning LLMs, which is computationally expensive and time-consuming. Moreover, it generates biased and undesirable responses by the user. A model that can efficiently adapt to user preferences in real time by integrating algorithms that can interfere at inference time is needed. This method will avoid retraining the models repeatedly for desired results by freezing the base model and reducing the computational cost of fine-tuning LLMs.

学習ベースのアルゴリズムでモデルをトレーニングした後に人間の価値観を統合するには、LLM の微調整が必要ですが、これには計算コストと時間がかかります。さらに、ユーザーによる偏った望ましくない応答が生成されます。推論時に干渉する可能性のあるアルゴリズムを統合することで、ユーザーの好みにリアルタイムで効率的に適応できるモデルが必要です。この方法では、ベース モデルをフリーズし、LLM の微調整にかかる計算コストを削減することで、望ましい結果を得るためにモデルを繰り返し再トレーニングする必要がなくなります。

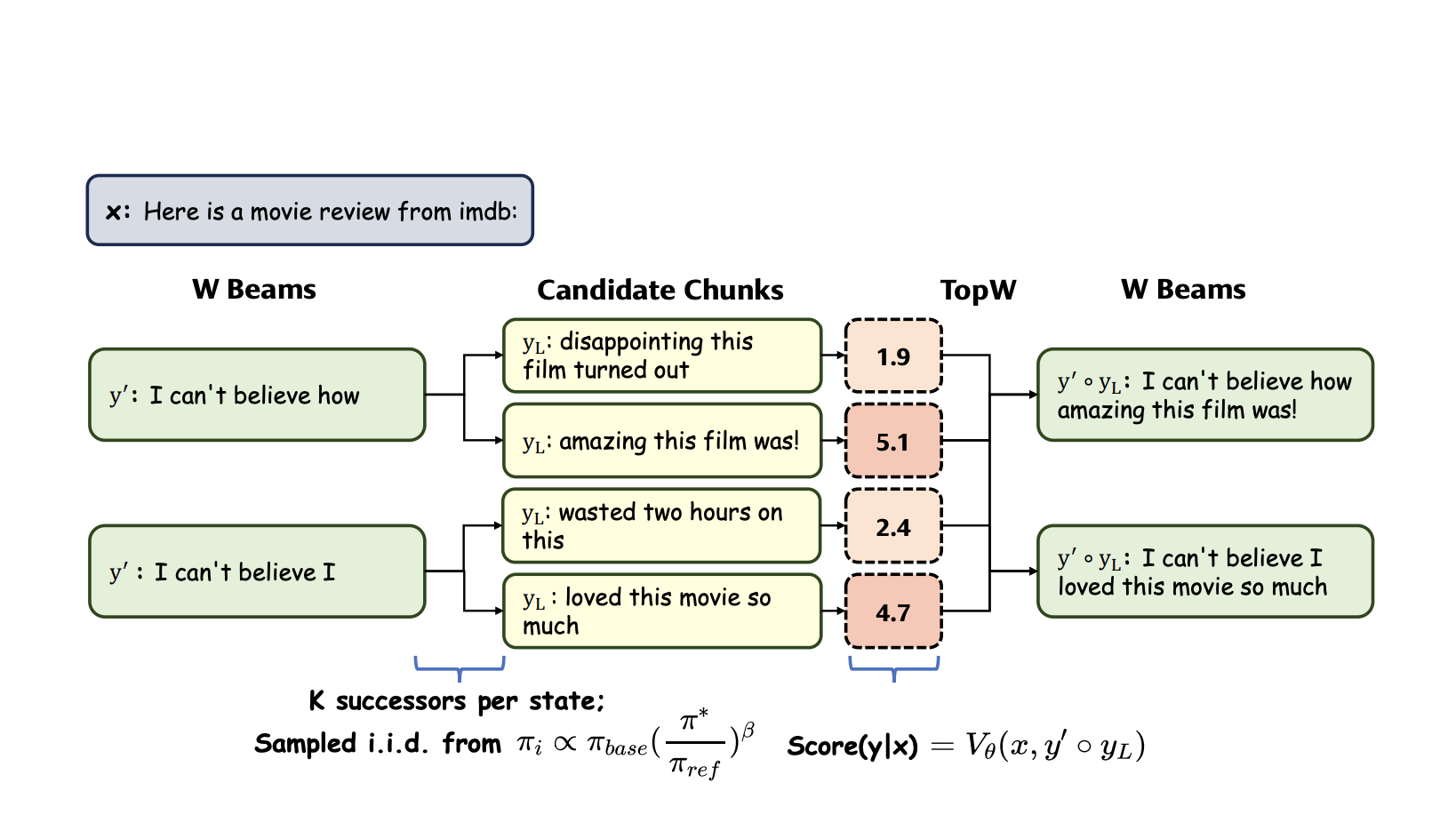

Researchers developed Inference-time alignment methods to integrate human values after fine-tuning LLMs using the implicit and explicit functions without changing the base model. Implicit functions are used for token generation, which conducts word-by-word evaluations and prefers the output with the highest probability. In contrast, explicit functions require a rigid structure to evaluate larger chunks of text and generate the following sequence of words with the highest probability while maintaining overall context. The explicit function is inflexible and computationally expensive, failing to address token-level optimization, while the implicit function faces interpretability issues and requires frequent forward passes, leading to low real-time efficiency.

研究者らは、基本モデルを変更せずに陰的関数と陽的関数を使用して LLM を微調整した後、人間の価値を統合する推論時間アライメント手法を開発しました。トークンの生成には暗黙的な関数が使用され、単語ごとに評価が行われ、最も高い確率の出力が優先されます。対照的に、明示的な関数では、全体的なコンテキストを維持しながら、より大きなテキストの塊を評価し、最も高い確率で次の単語のシーケンスを生成するための厳格な構造が必要です。明示的関数は柔軟性に欠け、計算コストが高く、トークンレベルの最適化に対処できません。一方、暗黙的関数は解釈可能性の問題に直面し、頻繁に前方パスを必要とするため、リアルタイム効率が低くなります。

To tackle the disadvantages of both functions, the proposed method, Integrated Value Guidance (IVG), combines the implicit function’s token-level optimization and the explicit function’s broader perspective. It was able to ward off adaptation challenges and trade-offs in alignment efficacy, leading to decreased performance discrepancies and making it easier to implement. These advantages facilitated better performance on tasks like controlled sentiment generation and summarization. IVG, combined with the smaller models like GPT-2, could compete with higher models.

両方の関数の欠点に対処するために、提案された手法である Integrated Value Guide (IVG) は、暗黙的関数のトークンレベルの最適化と明示的関数のより広い観点を組み合わせています。適応の課題や調整効果のトレードオフを回避することができ、パフォーマンスの不一致が減少し、実装が容易になりました。これらの利点により、制御された感情の生成や要約などのタスクのパフォーマンスが向上しました。 IVG を GPT-2 などの小型モデルと組み合わせると、上位モデルと競合できる可能性があります。

IVG incorporates the two value functions, the implicit and explicit functions, to align the model with human values. First, token-wise sampling fine-tunes individual tokens to a specific sequence length, generating multiple sequences. Then, chunk-level beam search compares the probabilities of these sequences and selects the one with the highest probability. Although this method ensures that the output is more robust, the computational power increases during the inference time due to frequent forward passes, leading to slower responses.

IVG には、モデルを人間の価値観に合わせるために、暗黙的関数と明示的関数という 2 つの値関数が組み込まれています。まず、トークンごとのサンプリングにより、個々のトークンが特定のシーケンス長に微調整され、複数のシーケンスが生成されます。次に、チャンクレベルのビーム検索でこれらのシーケンスの確率を比較し、最も高い確率を持つシーケンスを選択します。この方法では出力がより堅牢になりますが、頻繁な前方パスにより推論時間中の計算能力が増加し、応答が遅くなります。

Researchers have used two experimental set-ups to evaluate IVG: 1. Controlled sentiment generation and Summarization, and 2. Instruction-following. In the first one, the GPT-2 model family is used by leveraging synthetic datasets from a gold-reward model to generate positive movie reviews and summarise Reddit posts. In comparison, the second one requires an instruction-tuned model, AlpacaEval 2.0. It employs Tulu Guidance, which uses specific models for implicit function and trains a reward-based model for the explicit function, and Ultraguidance, which fine-tunes a model with Direct Preference Optimization (DPO) for both functions. GPT-4-turbo was used as a reference to assess responses in the second experiment, and IVG consistently performed well.

研究者らは、IVG を評価するために 2 つの実験設定を使用しました。1. 制御された感情の生成と要約、2. 指示への追従。 1 つ目では、金賞モデルの合成データセットを活用して GPT-2 モデル ファミリーを使用し、肯定的な映画レビューを生成し、Reddit の投稿を要約します。比較すると、2 番目のモデルでは、命令調整されたモデルである AlpacaEval 2.0 が必要です。これは、暗黙的関数には特定のモデルを使用し、明示的関数には報酬ベースのモデルをトレーニングする Tulu ガイダンスと、両方の関数に対して Direct Preference Optimization (DPO) を使用してモデルを微調整する Ultraguidance を採用しています。 GPT-4-turbo は 2 番目の実験で反応を評価するための参照として使用され、IVG は一貫して良好なパフォーマンスを示しました。

In addition to these two experiments, an ablation study proved that Chunk-Level Beam Search (CBS) had higher speed efficiency than Emulator Fine-Tuning (EFT), which uses the implicit function for fine-tuning. These results have proved that CBS is much better to use in practice.

これら 2 つの実験に加え、アブレーション研究により、チャンクレベル ビーム サーチ (CBS) の方が、微調整に陰関数を使用するエミュレータ微調整 (EFT) よりも高速効率が高いことが証明されました。これらの結果は、CBS が実際に使用するのにはるかに優れていることを証明しました。

In conclusion, Integrated Value Guidance (IVG) offers a novel and efficient approach to aligning large language models with human preferences purely at inference time, bypassing the complexities of traditional fine-tuning. By leveraging implicit and explicit value functions, IVG enhances performance in both token-wise sampling and chunk-level decoding, as demonstrated through significant improvements in sentiment generation, summarization, and instruction-following tasks. The results showed that IVG is a versatile method, providing strong empirical evidence of its ability to outclass existing approaches, making it a promising solution for fine-tuning large models in real-world applications.

結論として、Integrated Value Guide (IVG) は、従来の微調整の複雑さを回避し、純粋に推論時に大規模な言語モデルを人間の好みに合わせて調整するための斬新で効率的なアプローチを提供します。暗黙的および明示的な値関数を活用することで、IVG はトークン単位のサンプリングとチャンクレベルのデコードの両方のパフォーマンスを向上させます。これは、センチメントの生成、要約、および指示に従うタスクの大幅な改善を通じて実証されています。結果は、IVG が汎用性の高い手法であることを示し、既存のアプローチを上回る能力を示す強力な経験的証拠を提供し、現実世界のアプリケーションで大規模モデルを微調整するための有望なソリューションとなることを示しました。

Don’t Forget to join our 50k+ ML SubReddit

50,000 以上の ML SubReddit に忘れずに参加してください

Want to get in front of 1 Million+ AI Readers? Work with us here

100 万人以上の AI 読者の前に出たいですか?ここで私たちと一緒に働きましょう

免責事項:info@kdj.com

提供される情報は取引に関するアドバイスではありません。 kdj.com は、この記事で提供される情報に基づいて行われた投資に対して一切の責任を負いません。暗号通貨は変動性が高いため、十分な調査を行った上で慎重に投資することを強くお勧めします。

このウェブサイトで使用されているコンテンツが著作権を侵害していると思われる場合は、直ちに当社 (info@kdj.com) までご連絡ください。速やかに削除させていただきます。