|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Nachrichtenartikel zu Kryptowährungen

IVG: Integration menschlicher Werte in große Sprachmodelle zur Inferenzzeit

Oct 03, 2024 at 01:37 pm

Die Forscher entwickelten Inferenzzeit-Ausrichtungsmethoden, um menschliche Werte zu integrieren, nachdem sie LLMs mithilfe der impliziten und expliziten Funktionen verfeinert hatten, ohne das Basismodell zu ändern.

Integrating human values after training a model with Learning-based algorithms requires fine-tuning LLMs, which is computationally expensive and time-consuming. Moreover, it generates biased and undesirable responses by the user. A model that can efficiently adapt to user preferences in real time by integrating algorithms that can interfere at inference time is needed. This method will avoid retraining the models repeatedly for desired results by freezing the base model and reducing the computational cost of fine-tuning LLMs.

Die Integration menschlicher Werte nach dem Training eines Modells mit lernbasierten Algorithmen erfordert eine Feinabstimmung von LLMs, was rechenintensiv und zeitaufwändig ist. Darüber hinaus führt es zu voreingenommenen und unerwünschten Reaktionen des Benutzers. Benötigt wird ein Modell, das sich in Echtzeit effizient an Benutzerpräferenzen anpassen kann, indem es Algorithmen integriert, die zum Zeitpunkt der Inferenz interferieren können. Diese Methode vermeidet ein wiederholtes Umschulen der Modelle für gewünschte Ergebnisse, indem das Basismodell eingefroren wird und der Rechenaufwand für die Feinabstimmung von LLMs reduziert wird.

Researchers developed Inference-time alignment methods to integrate human values after fine-tuning LLMs using the implicit and explicit functions without changing the base model. Implicit functions are used for token generation, which conducts word-by-word evaluations and prefers the output with the highest probability. In contrast, explicit functions require a rigid structure to evaluate larger chunks of text and generate the following sequence of words with the highest probability while maintaining overall context. The explicit function is inflexible and computationally expensive, failing to address token-level optimization, while the implicit function faces interpretability issues and requires frequent forward passes, leading to low real-time efficiency.

Die Forscher entwickelten Inferenzzeit-Ausrichtungsmethoden, um menschliche Werte zu integrieren, nachdem sie LLMs mithilfe der impliziten und expliziten Funktionen verfeinert hatten, ohne das Basismodell zu ändern. Für die Token-Generierung werden implizite Funktionen verwendet, die wortweise Auswertungen durchführen und die Ausgabe mit der höchsten Wahrscheinlichkeit bevorzugen. Im Gegensatz dazu erfordern explizite Funktionen eine starre Struktur, um größere Textabschnitte auszuwerten und die folgende Wortfolge mit der höchsten Wahrscheinlichkeit zu generieren und dabei den Gesamtkontext beizubehalten. Die explizite Funktion ist unflexibel und rechenintensiv, da sie die Optimierung auf Token-Ebene nicht berücksichtigt, während die implizite Funktion mit Problemen bei der Interpretierbarkeit konfrontiert ist und häufige Vorwärtsdurchläufe erfordert, was zu einer geringen Echtzeiteffizienz führt.

To tackle the disadvantages of both functions, the proposed method, Integrated Value Guidance (IVG), combines the implicit function’s token-level optimization and the explicit function’s broader perspective. It was able to ward off adaptation challenges and trade-offs in alignment efficacy, leading to decreased performance discrepancies and making it easier to implement. These advantages facilitated better performance on tasks like controlled sentiment generation and summarization. IVG, combined with the smaller models like GPT-2, could compete with higher models.

Um die Nachteile beider Funktionen anzugehen, kombiniert die vorgeschlagene Methode, Integrated Value Guidance (IVG), die Optimierung auf Token-Ebene der impliziten Funktion und die breitere Perspektive der expliziten Funktion. Es war in der Lage, Anpassungsherausforderungen und Kompromisse bei der Ausrichtungseffizienz abzuwehren, was zu geringeren Leistungsunterschieden führte und die Implementierung erleichterte. Diese Vorteile ermöglichten eine bessere Leistung bei Aufgaben wie der kontrollierten Sentimentgenerierung und -zusammenfassung. IVG könnte in Kombination mit kleineren Modellen wie GPT-2 mit höheren Modellen konkurrieren.

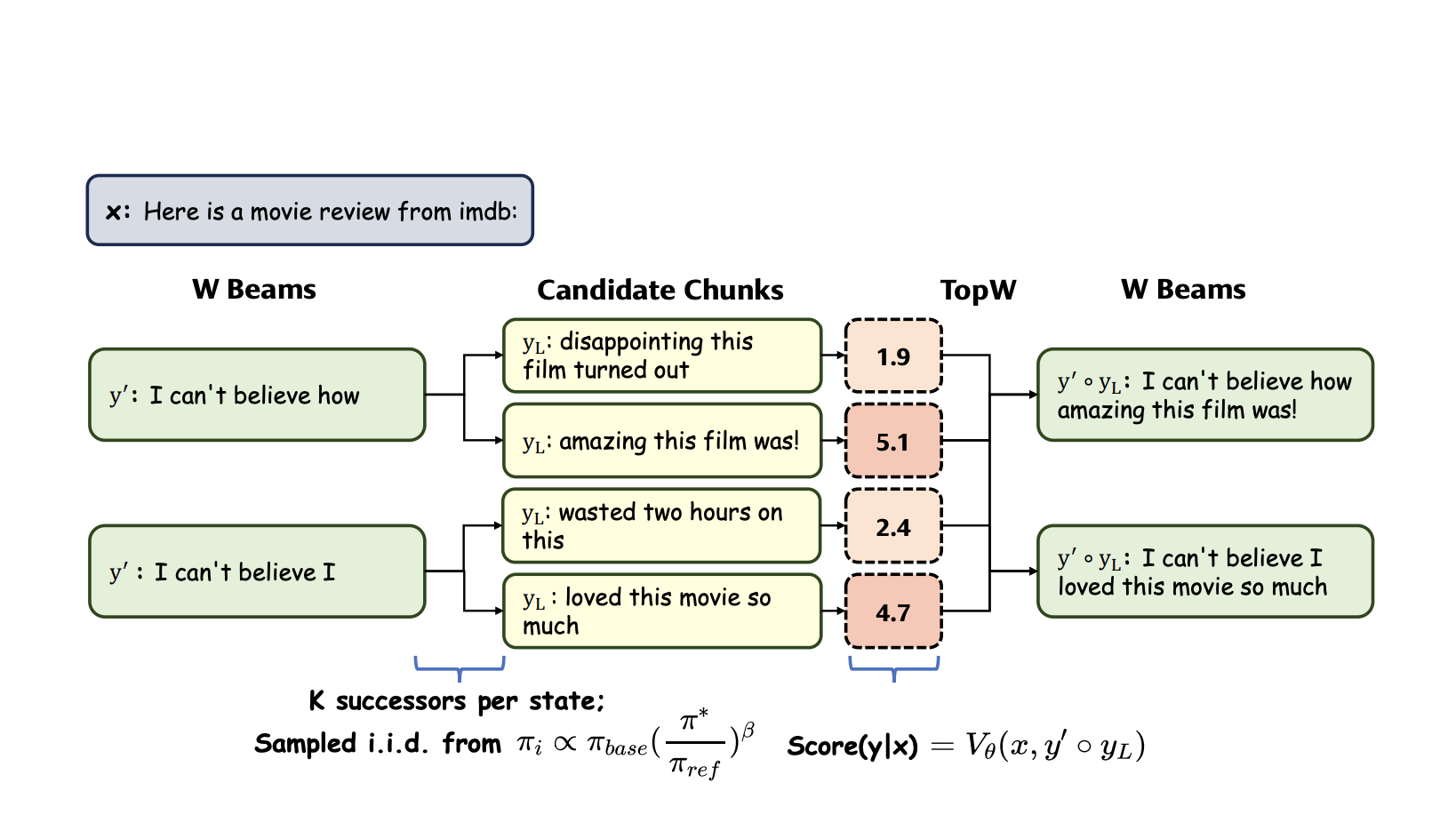

IVG incorporates the two value functions, the implicit and explicit functions, to align the model with human values. First, token-wise sampling fine-tunes individual tokens to a specific sequence length, generating multiple sequences. Then, chunk-level beam search compares the probabilities of these sequences and selects the one with the highest probability. Although this method ensures that the output is more robust, the computational power increases during the inference time due to frequent forward passes, leading to slower responses.

IVG integriert die beiden Wertfunktionen, die implizite und die explizite Funktion, um das Modell an menschlichen Werten auszurichten. Erstens werden durch tokenweises Sampling einzelne Token auf eine bestimmte Sequenzlänge abgestimmt, wodurch mehrere Sequenzen generiert werden. Anschließend vergleicht die Strahlsuche auf Chunk-Ebene die Wahrscheinlichkeiten dieser Sequenzen und wählt die Sequenz mit der höchsten Wahrscheinlichkeit aus. Obwohl diese Methode sicherstellt, dass die Ausgabe robuster ist, steigt die Rechenleistung während der Inferenzzeit aufgrund häufiger Vorwärtsdurchläufe, was zu langsameren Reaktionen führt.

Researchers have used two experimental set-ups to evaluate IVG: 1. Controlled sentiment generation and Summarization, and 2. Instruction-following. In the first one, the GPT-2 model family is used by leveraging synthetic datasets from a gold-reward model to generate positive movie reviews and summarise Reddit posts. In comparison, the second one requires an instruction-tuned model, AlpacaEval 2.0. It employs Tulu Guidance, which uses specific models for implicit function and trains a reward-based model for the explicit function, and Ultraguidance, which fine-tunes a model with Direct Preference Optimization (DPO) for both functions. GPT-4-turbo was used as a reference to assess responses in the second experiment, and IVG consistently performed well.

Forscher haben zwei Versuchsanordnungen verwendet, um IVG zu evaluieren: 1. Kontrollierte Stimmungserzeugung und -zusammenfassung und 2. Befolgen von Anweisungen. Im ersten Fall wird die GPT-2-Modellfamilie verwendet, indem synthetische Datensätze aus einem Gold-Belohnungsmodell genutzt werden, um positive Filmrezensionen zu generieren und Reddit-Beiträge zusammenzufassen. Im Vergleich dazu erfordert das zweite ein auf Anweisungen abgestimmtes Modell, AlpacaEval 2.0. Es verwendet Tulu Guidance, das spezifische Modelle für implizite Funktionen verwendet und ein belohnungsbasiertes Modell für die explizite Funktion trainiert, und Ultraguidance, das ein Modell mit Direct Preference Optimization (DPO) für beide Funktionen verfeinert. GPT-4-turbo wurde als Referenz zur Bewertung der Reaktionen im zweiten Experiment verwendet, und IVG schnitt durchweg gut ab.

In addition to these two experiments, an ablation study proved that Chunk-Level Beam Search (CBS) had higher speed efficiency than Emulator Fine-Tuning (EFT), which uses the implicit function for fine-tuning. These results have proved that CBS is much better to use in practice.

Zusätzlich zu diesen beiden Experimenten bewies eine Ablationsstudie, dass Chunk-Level Beam Search (CBS) eine höhere Geschwindigkeitseffizienz aufweist als Emulator Fine-Tuning (EFT), das die implizite Funktion zur Feinabstimmung verwendet. Diese Ergebnisse haben gezeigt, dass CBS in der Praxis viel besser anwendbar ist.

In conclusion, Integrated Value Guidance (IVG) offers a novel and efficient approach to aligning large language models with human preferences purely at inference time, bypassing the complexities of traditional fine-tuning. By leveraging implicit and explicit value functions, IVG enhances performance in both token-wise sampling and chunk-level decoding, as demonstrated through significant improvements in sentiment generation, summarization, and instruction-following tasks. The results showed that IVG is a versatile method, providing strong empirical evidence of its ability to outclass existing approaches, making it a promising solution for fine-tuning large models in real-world applications.

Zusammenfassend bietet Integrated Value Guidance (IVG) einen neuartigen und effizienten Ansatz, um große Sprachmodelle ausschließlich zum Zeitpunkt der Inferenz an menschlichen Präferenzen auszurichten und dabei die Komplexität der traditionellen Feinabstimmung zu umgehen. Durch die Nutzung impliziter und expliziter Wertfunktionen steigert IVG die Leistung sowohl beim tokenweisen Sampling als auch bei der Decodierung auf Chunk-Ebene, was durch signifikante Verbesserungen bei Sentiment-Generierung, Zusammenfassung und Befehlsfolgeaufgaben gezeigt wird. Die Ergebnisse zeigten, dass IVG eine vielseitige Methode ist, die starke empirische Beweise dafür liefert, dass sie bestehende Ansätze übertreffen kann, was sie zu einer vielversprechenden Lösung für die Feinabstimmung großer Modelle in realen Anwendungen macht.

Don’t Forget to join our 50k+ ML SubReddit

Vergessen Sie nicht, unserem 50k+ ML SubReddit beizutreten

Want to get in front of 1 Million+ AI Readers? Work with us here

Möchten Sie mehr als 1 Million KI-Lesern erreichen? Arbeiten Sie hier mit uns zusammen

Haftungsausschluss:info@kdj.com

Die bereitgestellten Informationen stellen keine Handelsberatung dar. kdj.com übernimmt keine Verantwortung für Investitionen, die auf der Grundlage der in diesem Artikel bereitgestellten Informationen getätigt werden. Kryptowährungen sind sehr volatil und es wird dringend empfohlen, nach gründlicher Recherche mit Vorsicht zu investieren!

Wenn Sie glauben, dass der auf dieser Website verwendete Inhalt Ihr Urheberrecht verletzt, kontaktieren Sie uns bitte umgehend (info@kdj.com) und wir werden ihn umgehend löschen.

-

- Artemis Coin: Ein revolutionäres Vorverkaufs-Kryptoprojekt, das das dezentrale Finanzwesen neu gestalten wird

- Oct 03, 2024 at 04:25 pm

- Im dynamischen Bereich der Kryptowährungen ist ein neuer Konkurrent aufgetaucht, der Investoren und Enthusiasten gleichermaßen mit seiner bahnbrechenden Vision und seinem innovativen Ansatz fasziniert. Artemis Coin, ein hochmoderner digitaler Vermögenswert, hat die Kryptowelt im Sturm erobert und sich als vielversprechendes Vorverkaufs-Kryptoprojekt mit dem Potenzial positioniert, die Landschaft der dezentralen Finanzierung neu zu gestalten.

-

-

- Shiba Inu (SHIB) steigt in die Riege der von Walen bevorzugten Altcoins ein, Transaktionszahl steigt um 360 %

- Oct 03, 2024 at 04:25 pm

- In der vergangenen Woche haben On-Chain-Daten einen deutlichen Anstieg des Interesses von Walen an Shiba Inu gezeigt, was den Altcoin zu einem der beliebtesten Token dieser Großinvestoren macht.

-

- Cutoshi (CUTO): Eine vielversprechende neue Meme-Münze auf der Ethereum-Blockchain

- Oct 03, 2024 at 04:25 pm

- Während der Preis von Ethereum und die DeFi-Aktivität in die Höhe schießen, suchen Anleger nach unterbewerteten Gelegenheiten. Cutoshi, eine vielversprechende neue Meme-Münze auf der Ethereum-Blockchain, hat sich als potenzielles verstecktes Juwel herausgestellt.

-

- Warum Scharen von Investoren Moodeng ETH bevorzugen, statt Shiba Inu und Brett Coin, die frühere Marktfavoriten waren

- Oct 03, 2024 at 04:25 pm

- Wenn Sie das Glück gehabt hätten, einer der ersten Investoren beim Vorverkauf von Floki Inu, Dogecoin oder Shiba Inu zu sein, hätten Sie Millionengewinne gemacht.

-

- Wie geht es für Ripple nach der SEC-Beschwerde weiter? Wird der XRP-Preis abstürzen?

- Oct 03, 2024 at 04:25 pm

- Die US-Börsenaufsichtsbehörde Securities and Exchange Commission gab gestern bekannt, dass sie gegen das Urteil von Richterin Analisa Torres Berufung einlegen wird, das XRP einen Sieg gegen sie bescherte. Der Berufungsbescheid ist gestern eingegangen.

-

- Swyftx-Analysten befassen sich mit den jüngsten Bewegungen auf dem Kryptomarkt und enthüllen die Faktoren, die den Anstieg im Memecoin-Sektor und anderen Top-Gewinnern dieser Woche antreiben

- Oct 03, 2024 at 04:25 pm

- Die Analysten von Swyftx haben sich mit den jüngsten Bewegungen auf dem Kryptomarkt befasst und die Faktoren aufgedeckt, die den jüngsten Aufschwung im Memecoin-Sektor und anderen Bereichen antreiben

-

- Überprüfen Sie Ihr Wechselgeld! Eine seltene 20-Pence-Münze aus dem Jahr 2008 wird bei eBay für 780 £ verkauft – das 390-fache ihres Nennwerts

- Oct 03, 2024 at 04:25 pm

- Nachdem eine seltene 20-Pence-Münze diese Woche für das 390-fache ihres Nennwerts verkauft wurde, werden wir alle ermutigt, unser Kleingeld zu prüfen. Das 20-Pence-Stück ist eine „Mule“-Münze aus dem Jahr 2008 und wurde aufgrund eines Fehlers ohne Datum auf der Münze geprägt.

-