|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

연구원들은 기본 모델을 변경하지 않고 암시적 및 명시적 함수를 사용하여 LLM을 미세 조정한 후 인간 가치를 통합하는 추론 시간 정렬 방법을 개발했습니다.

Integrating human values after training a model with Learning-based algorithms requires fine-tuning LLMs, which is computationally expensive and time-consuming. Moreover, it generates biased and undesirable responses by the user. A model that can efficiently adapt to user preferences in real time by integrating algorithms that can interfere at inference time is needed. This method will avoid retraining the models repeatedly for desired results by freezing the base model and reducing the computational cost of fine-tuning LLMs.

학습 기반 알고리즘으로 모델을 훈련한 후 인간의 가치를 통합하려면 LLM을 미세 조정해야 하는데, 이는 계산 비용과 시간이 많이 소요됩니다. 더욱이 이는 사용자로부터 편향되고 바람직하지 않은 반응을 생성합니다. 추론 시 간섭할 수 있는 알고리즘을 통합하여 사용자 선호도에 실시간으로 효율적으로 적응할 수 있는 모델이 필요합니다. 이 방법은 기본 모델을 동결하고 LLM 미세 조정에 드는 계산 비용을 줄임으로써 원하는 결과를 얻기 위해 모델을 반복적으로 재교육하는 것을 방지합니다.

Researchers developed Inference-time alignment methods to integrate human values after fine-tuning LLMs using the implicit and explicit functions without changing the base model. Implicit functions are used for token generation, which conducts word-by-word evaluations and prefers the output with the highest probability. In contrast, explicit functions require a rigid structure to evaluate larger chunks of text and generate the following sequence of words with the highest probability while maintaining overall context. The explicit function is inflexible and computationally expensive, failing to address token-level optimization, while the implicit function faces interpretability issues and requires frequent forward passes, leading to low real-time efficiency.

연구원들은 기본 모델을 변경하지 않고 암시적 및 명시적 함수를 사용하여 LLM을 미세 조정한 후 인간 가치를 통합하는 추론 시간 정렬 방법을 개발했습니다. 암시적 함수는 단어 단위로 평가를 수행하고 가장 높은 확률의 출력을 선호하는 토큰 생성에 사용됩니다. 대조적으로, 명시적 함수는 더 큰 텍스트 덩어리를 평가하고 전반적인 맥락을 유지하면서 가장 높은 확률로 다음 단어 시퀀스를 생성하기 위해 엄격한 구조를 필요로 합니다. 명시적 함수는 유연성이 없고 계산 비용이 많이 들기 때문에 토큰 수준 최적화를 해결하지 못하는 반면, 암시적 함수는 해석 가능성 문제에 직면하고 빈번한 전달이 필요하므로 실시간 효율성이 낮습니다.

To tackle the disadvantages of both functions, the proposed method, Integrated Value Guidance (IVG), combines the implicit function’s token-level optimization and the explicit function’s broader perspective. It was able to ward off adaptation challenges and trade-offs in alignment efficacy, leading to decreased performance discrepancies and making it easier to implement. These advantages facilitated better performance on tasks like controlled sentiment generation and summarization. IVG, combined with the smaller models like GPT-2, could compete with higher models.

두 기능의 단점을 해결하기 위해 제안된 방법인 IVG(Integrated Value Guidance)는 암시적 함수의 토큰 수준 최적화와 명시적 함수의 더 넓은 관점을 결합합니다. 이는 적응 문제와 정렬 효율성의 상충 관계를 방지하여 성능 불일치를 줄이고 구현을 더 쉽게 만들 수 있었습니다. 이러한 이점은 제어된 감정 생성 및 요약과 같은 작업에서 더 나은 성능을 촉진했습니다. GPT-2와 같은 소형 모델과 결합된 IVG는 상위 모델과 경쟁할 수 있습니다.

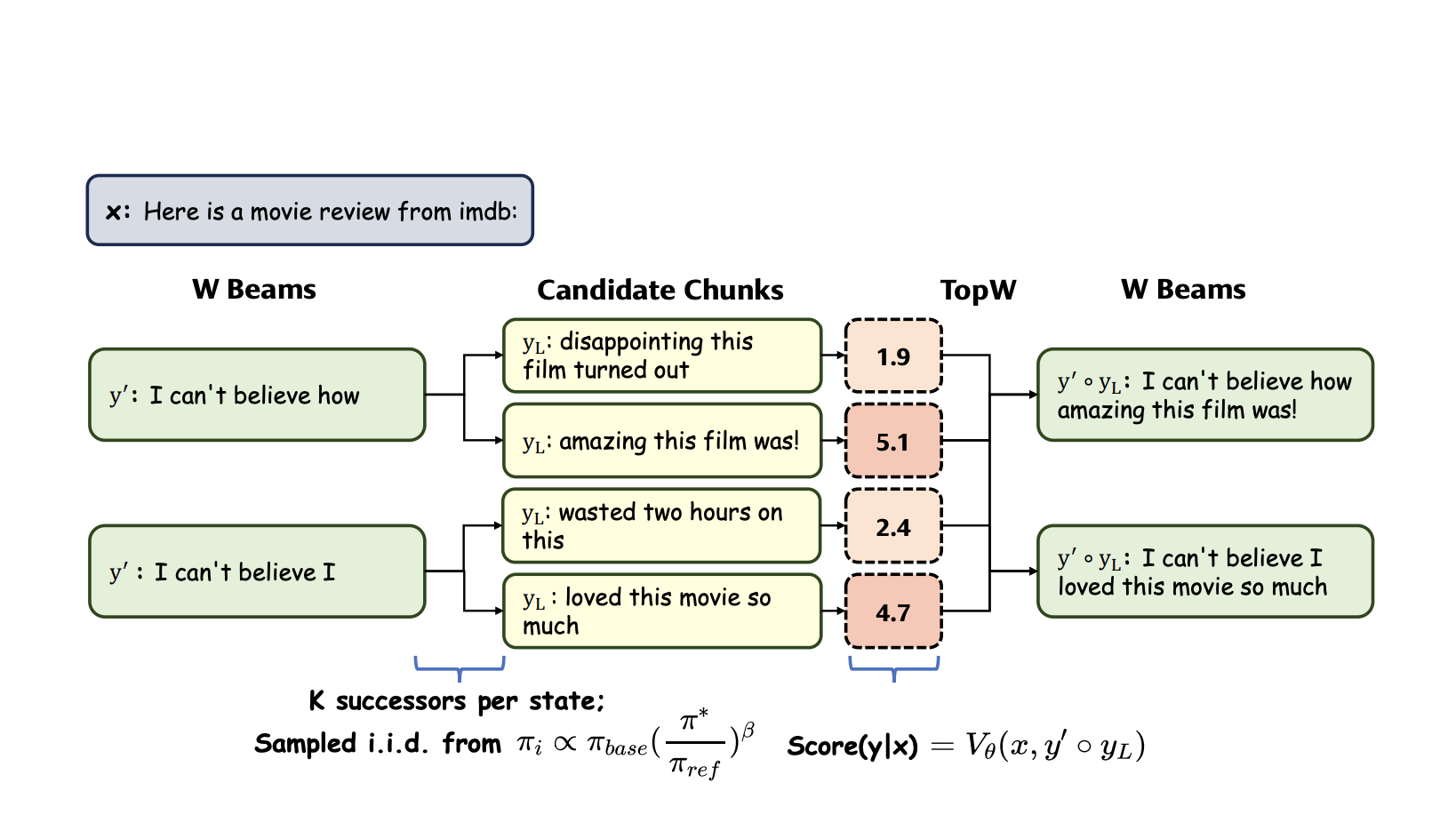

IVG incorporates the two value functions, the implicit and explicit functions, to align the model with human values. First, token-wise sampling fine-tunes individual tokens to a specific sequence length, generating multiple sequences. Then, chunk-level beam search compares the probabilities of these sequences and selects the one with the highest probability. Although this method ensures that the output is more robust, the computational power increases during the inference time due to frequent forward passes, leading to slower responses.

IVG는 모델을 인간의 가치에 맞추기 위해 암시적 함수와 명시적 함수라는 두 가지 가치 함수를 통합합니다. 첫째, 토큰 방식 샘플링은 개별 토큰을 특정 시퀀스 길이로 미세 조정하여 여러 시퀀스를 생성합니다. 그런 다음 청크 수준 빔 검색은 이러한 시퀀스의 확률을 비교하고 확률이 가장 높은 시퀀스를 선택합니다. 이 방법을 사용하면 출력이 더 강력해지지만 잦은 순방향 전달로 인해 추론 시간 동안 계산 능력이 증가하여 응답 속도가 느려집니다.

Researchers have used two experimental set-ups to evaluate IVG: 1. Controlled sentiment generation and Summarization, and 2. Instruction-following. In the first one, the GPT-2 model family is used by leveraging synthetic datasets from a gold-reward model to generate positive movie reviews and summarise Reddit posts. In comparison, the second one requires an instruction-tuned model, AlpacaEval 2.0. It employs Tulu Guidance, which uses specific models for implicit function and trains a reward-based model for the explicit function, and Ultraguidance, which fine-tunes a model with Direct Preference Optimization (DPO) for both functions. GPT-4-turbo was used as a reference to assess responses in the second experiment, and IVG consistently performed well.

연구자들은 IVG를 평가하기 위해 두 가지 실험 설정을 사용했습니다. 1. 제어된 감정 생성 및 요약, 2. 지시 따르기. 첫 번째에서는 GPT-2 모델 계열을 사용하여 금 보상 모델의 합성 데이터 세트를 활용하여 긍정적인 영화 리뷰를 생성하고 Reddit 게시물을 요약합니다. 이에 비해 두 번째 모델에는 명령 조정 모델인 AlpacaEval 2.0이 필요합니다. 이는 암시적 기능에 대해 특정 모델을 사용하고 명시적 기능에 대해 보상 기반 모델을 훈련하는 Tulu Guidance와 두 기능 모두에 대해 DPO(Direct Preference Optimization)를 사용하여 모델을 미세 조정하는 Ultraguidance를 사용합니다. GPT-4-turbo는 두 번째 실험에서 반응을 평가하기 위한 참고 자료로 사용되었으며 IVG는 지속적으로 좋은 성능을 보였습니다.

In addition to these two experiments, an ablation study proved that Chunk-Level Beam Search (CBS) had higher speed efficiency than Emulator Fine-Tuning (EFT), which uses the implicit function for fine-tuning. These results have proved that CBS is much better to use in practice.

이 두 가지 실험 외에도 절제 연구를 통해 CBS(Chunk-level Beam Search)가 미세 조정을 위해 암시적 함수를 사용하는 EFT(Emulator Fine-Tuning)보다 속도 효율성이 더 높다는 것이 입증되었습니다. 이러한 결과는 CBS가 실제로 사용하기에 훨씬 더 좋다는 것을 입증했습니다.

In conclusion, Integrated Value Guidance (IVG) offers a novel and efficient approach to aligning large language models with human preferences purely at inference time, bypassing the complexities of traditional fine-tuning. By leveraging implicit and explicit value functions, IVG enhances performance in both token-wise sampling and chunk-level decoding, as demonstrated through significant improvements in sentiment generation, summarization, and instruction-following tasks. The results showed that IVG is a versatile method, providing strong empirical evidence of its ability to outclass existing approaches, making it a promising solution for fine-tuning large models in real-world applications.

결론적으로 IVG(Integrated Value Guidance)는 전통적인 미세 조정의 복잡성을 우회하여 순전히 추론 시간에 대규모 언어 모델을 인간 선호도에 맞추는 새롭고 효율적인 접근 방식을 제공합니다. IVG는 암시적 및 명시적 가치 함수를 활용하여 토큰 방식 샘플링과 청크 수준 디코딩 모두에서 성능을 향상시킵니다. 이는 감정 생성, 요약 및 지시 따르기 작업의 상당한 개선을 통해 입증되었습니다. 결과는 IVG가 기존 접근 방식을 능가할 수 있는 능력에 대한 강력한 경험적 증거를 제공하여 실제 응용 프로그램에서 대형 모델을 미세 조정하기 위한 유망한 솔루션이 되는 다목적 방법이라는 것을 보여주었습니다.

Don’t Forget to join our 50k+ ML SubReddit

50,000개 이상의 ML SubReddit에 참여하는 것을 잊지 마세요

Want to get in front of 1 Million+ AI Readers? Work with us here

100만 명이 넘는 AI 독자들 앞에 다가가고 싶으십니까? 여기에서 우리와 함께 일하세요

부인 성명:info@kdj.com

제공된 정보는 거래 조언이 아닙니다. kdj.com은 이 기사에 제공된 정보를 기반으로 이루어진 투자에 대해 어떠한 책임도 지지 않습니다. 암호화폐는 변동성이 매우 높으므로 철저한 조사 후 신중하게 투자하는 것이 좋습니다!

본 웹사이트에 사용된 내용이 귀하의 저작권을 침해한다고 판단되는 경우, 즉시 당사(info@kdj.com)로 연락주시면 즉시 삭제하도록 하겠습니다.