|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Articles d’actualité sur les crypto-monnaies

IVG : Intégrer les valeurs humaines dans de grands modèles de langage au moment de l'inférence

Oct 03, 2024 at 01:37 pm

Les chercheurs ont développé des méthodes d'alignement du temps d'inférence pour intégrer les valeurs humaines après avoir affiné les LLM à l'aide des fonctions implicites et explicites sans modifier le modèle de base.

Integrating human values after training a model with Learning-based algorithms requires fine-tuning LLMs, which is computationally expensive and time-consuming. Moreover, it generates biased and undesirable responses by the user. A model that can efficiently adapt to user preferences in real time by integrating algorithms that can interfere at inference time is needed. This method will avoid retraining the models repeatedly for desired results by freezing the base model and reducing the computational cost of fine-tuning LLMs.

L'intégration des valeurs humaines après la formation d'un modèle avec des algorithmes basés sur l'apprentissage nécessite un réglage fin des LLM, ce qui est coûteux en termes de calcul et prend du temps. De plus, cela génère des réponses biaisées et indésirables de la part de l’utilisateur. Un modèle capable de s'adapter efficacement aux préférences de l'utilisateur en temps réel en intégrant des algorithmes pouvant interférer au moment de l'inférence est nécessaire. Cette méthode évitera de recycler les modèles à plusieurs reprises pour obtenir les résultats souhaités en gelant le modèle de base et en réduisant le coût de calcul lié au réglage fin des LLM.

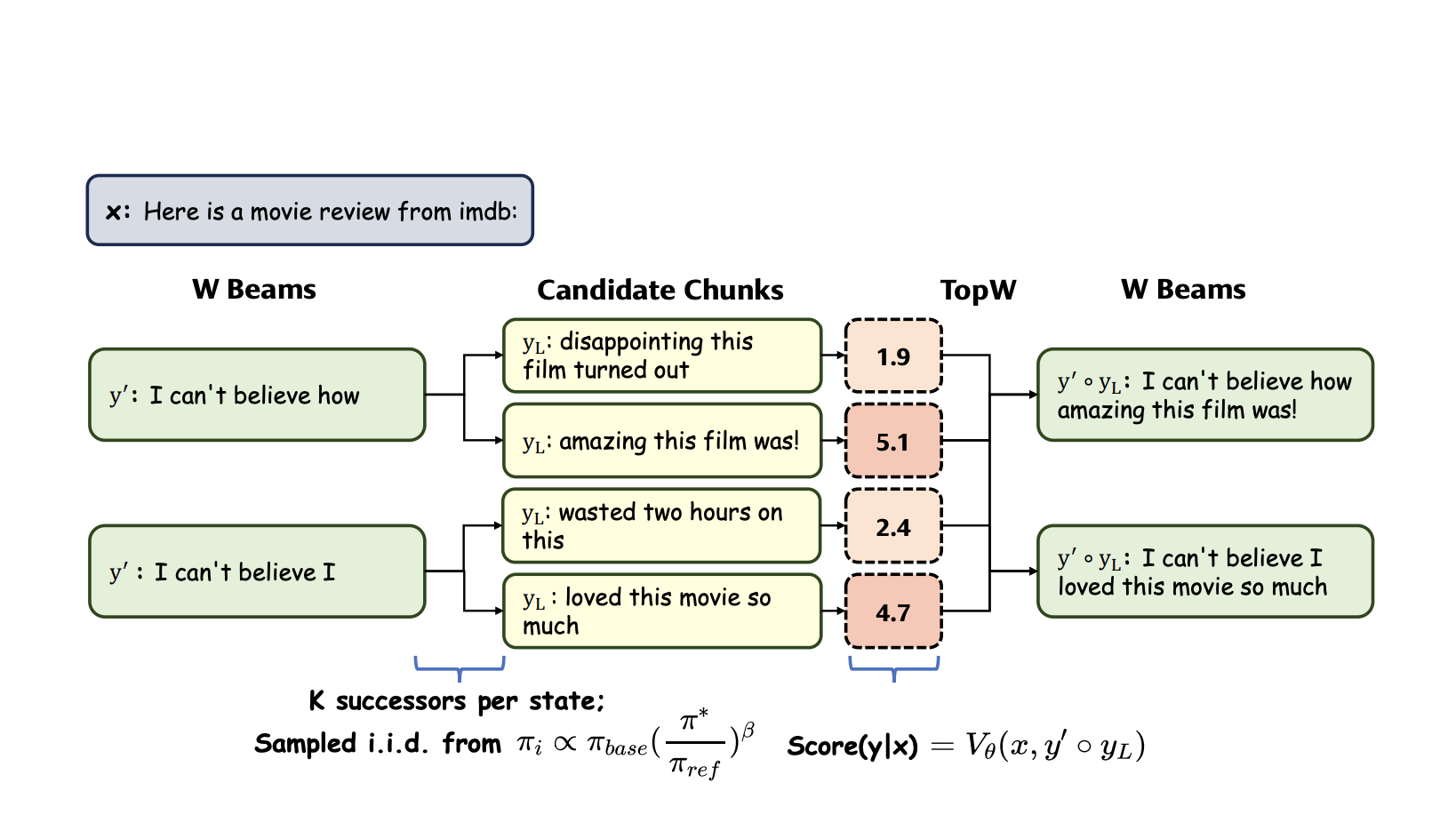

Researchers developed Inference-time alignment methods to integrate human values after fine-tuning LLMs using the implicit and explicit functions without changing the base model. Implicit functions are used for token generation, which conducts word-by-word evaluations and prefers the output with the highest probability. In contrast, explicit functions require a rigid structure to evaluate larger chunks of text and generate the following sequence of words with the highest probability while maintaining overall context. The explicit function is inflexible and computationally expensive, failing to address token-level optimization, while the implicit function faces interpretability issues and requires frequent forward passes, leading to low real-time efficiency.

Les chercheurs ont développé des méthodes d'alignement du temps d'inférence pour intégrer les valeurs humaines après avoir affiné les LLM à l'aide des fonctions implicites et explicites sans modifier le modèle de base. Des fonctions implicites sont utilisées pour la génération de jetons, qui effectue des évaluations mot par mot et préfère la sortie avec la probabilité la plus élevée. En revanche, les fonctions explicites nécessitent une structure rigide pour évaluer des morceaux de texte plus volumineux et générer la séquence de mots suivante avec la probabilité la plus élevée tout en conservant le contexte global. La fonction explicite est rigide et coûteuse en termes de calcul, ne parvenant pas à résoudre l'optimisation au niveau du jeton, tandis que la fonction implicite est confrontée à des problèmes d'interprétabilité et nécessite des passages en avant fréquents, ce qui conduit à une faible efficacité en temps réel.

To tackle the disadvantages of both functions, the proposed method, Integrated Value Guidance (IVG), combines the implicit function’s token-level optimization and the explicit function’s broader perspective. It was able to ward off adaptation challenges and trade-offs in alignment efficacy, leading to decreased performance discrepancies and making it easier to implement. These advantages facilitated better performance on tasks like controlled sentiment generation and summarization. IVG, combined with the smaller models like GPT-2, could compete with higher models.

Pour remédier aux inconvénients des deux fonctions, la méthode proposée, Integrated Value Guidance (IVG), combine l'optimisation au niveau du jeton de la fonction implicite et la perspective plus large de la fonction explicite. Il a permis d’éviter les défis d’adaptation et les compromis en termes d’efficacité de l’alignement, entraînant une diminution des écarts de performances et facilitant sa mise en œuvre. Ces avantages ont facilité de meilleures performances sur des tâches telles que la génération et la synthèse contrôlées de sentiments. IVG, combiné avec des modèles plus petits comme le GPT-2, pourrait rivaliser avec les modèles supérieurs.

IVG incorporates the two value functions, the implicit and explicit functions, to align the model with human values. First, token-wise sampling fine-tunes individual tokens to a specific sequence length, generating multiple sequences. Then, chunk-level beam search compares the probabilities of these sequences and selects the one with the highest probability. Although this method ensures that the output is more robust, the computational power increases during the inference time due to frequent forward passes, leading to slower responses.

IVG intègre les deux fonctions de valeur, les fonctions implicites et explicites, pour aligner le modèle sur les valeurs humaines. Premièrement, l'échantillonnage par jeton ajuste les jetons individuels à une longueur de séquence spécifique, générant ainsi plusieurs séquences. Ensuite, la recherche de faisceaux au niveau des morceaux compare les probabilités de ces séquences et sélectionne celle ayant la probabilité la plus élevée. Bien que cette méthode garantisse que la sortie est plus robuste, la puissance de calcul augmente pendant le temps d'inférence en raison des fréquentes passes avant, ce qui entraîne des réponses plus lentes.

Researchers have used two experimental set-ups to evaluate IVG: 1. Controlled sentiment generation and Summarization, and 2. Instruction-following. In the first one, the GPT-2 model family is used by leveraging synthetic datasets from a gold-reward model to generate positive movie reviews and summarise Reddit posts. In comparison, the second one requires an instruction-tuned model, AlpacaEval 2.0. It employs Tulu Guidance, which uses specific models for implicit function and trains a reward-based model for the explicit function, and Ultraguidance, which fine-tunes a model with Direct Preference Optimization (DPO) for both functions. GPT-4-turbo was used as a reference to assess responses in the second experiment, and IVG consistently performed well.

Les chercheurs ont utilisé deux dispositifs expérimentaux pour évaluer l'IVG : 1. Génération et résumé de sentiments contrôlés, et 2. Suivi des instructions. Dans le premier, la famille de modèles GPT-2 est utilisée en exploitant des ensembles de données synthétiques provenant d'un modèle de récompense en or pour générer des critiques de films positives et résumer les publications Reddit. En comparaison, le second nécessite un modèle optimisé pour les instructions, AlpacaEval 2.0. Il utilise Tulu Guidance, qui utilise des modèles spécifiques pour la fonction implicite et forme un modèle basé sur les récompenses pour la fonction explicite, et Ultraguidance, qui affine un modèle avec l'optimisation des préférences directes (DPO) pour les deux fonctions. GPT-4-turbo a été utilisé comme référence pour évaluer les réponses dans la deuxième expérience, et l'IVG a toujours bien fonctionné.

In addition to these two experiments, an ablation study proved that Chunk-Level Beam Search (CBS) had higher speed efficiency than Emulator Fine-Tuning (EFT), which uses the implicit function for fine-tuning. These results have proved that CBS is much better to use in practice.

En plus de ces deux expériences, une étude d'ablation a prouvé que la recherche de faisceaux au niveau des morceaux (CBS) avait une efficacité de vitesse supérieure à celle de l'émulateur de réglage fin (EFT), qui utilise la fonction implicite pour le réglage fin. Ces résultats ont prouvé que le CBS est bien meilleur à utiliser dans la pratique.

In conclusion, Integrated Value Guidance (IVG) offers a novel and efficient approach to aligning large language models with human preferences purely at inference time, bypassing the complexities of traditional fine-tuning. By leveraging implicit and explicit value functions, IVG enhances performance in both token-wise sampling and chunk-level decoding, as demonstrated through significant improvements in sentiment generation, summarization, and instruction-following tasks. The results showed that IVG is a versatile method, providing strong empirical evidence of its ability to outclass existing approaches, making it a promising solution for fine-tuning large models in real-world applications.

En conclusion, Integrated Value Guidance (IVG) propose une approche nouvelle et efficace pour aligner de grands modèles de langage sur les préférences humaines uniquement au moment de l'inférence, en contournant les complexités du réglage fin traditionnel. En tirant parti des fonctions de valeur implicites et explicites, IVG améliore les performances à la fois en matière d'échantillonnage par jeton et de décodage au niveau des blocs, comme le démontrent des améliorations significatives dans les tâches de génération de sentiments, de résumé et de suivi des instructions. Les résultats ont montré que l'IVG est une méthode polyvalente, fournissant des preuves empiriques solides de sa capacité à surclasser les approches existantes, ce qui en fait une solution prometteuse pour affiner les grands modèles dans des applications réelles.

Don’t Forget to join our 50k+ ML SubReddit

N'oubliez pas de rejoindre notre SubReddit de plus de 50 000 ML

Want to get in front of 1 Million+ AI Readers? Work with us here

Vous voulez vous présenter devant plus d’un million de lecteurs IA ? Travaillez avec nous ici

Clause de non-responsabilité:info@kdj.com

Les informations fournies ne constituent pas des conseils commerciaux. kdj.com n’assume aucune responsabilité pour les investissements effectués sur la base des informations fournies dans cet article. Les crypto-monnaies sont très volatiles et il est fortement recommandé d’investir avec prudence après une recherche approfondie!

Si vous pensez que le contenu utilisé sur ce site Web porte atteinte à vos droits d’auteur, veuillez nous contacter immédiatement (info@kdj.com) et nous le supprimerons dans les plus brefs délais.

-

- Artemis Coin : un projet de cryptographie révolutionnaire en prévente prêt à remodeler la finance décentralisée

- Oct 03, 2024 at 04:25 pm

- Dans le domaine dynamique des crypto-monnaies, un nouveau concurrent est apparu, captivant les investisseurs et les passionnés par sa vision révolutionnaire et son approche innovante. Artemis Coin, un actif numérique de pointe, a pris d'assaut le monde de la cryptographie, se positionnant comme un projet de cryptographie de prévente prometteur avec le potentiel de remodeler le paysage de la finance décentralisée.

-

-

- Shiba Inu (SHIB) entre dans les rangs des Altcoins préférés des baleines, le nombre de transactions augmente de 360 %

- Oct 03, 2024 at 04:25 pm

- Au cours de la semaine dernière, les données en chaîne ont révélé une nette augmentation de l'intérêt des baleines pour le Shiba Inu, positionnant l'altcoin parmi les plus favorisés par ces grands investisseurs.

-

- Cutoshi (CUTO) : une nouvelle pièce de monnaie prometteuse sur la blockchain Ethereum

- Oct 03, 2024 at 04:25 pm

- Alors que le prix d’Ethereum et l’activité DeFi montent en flèche, les investisseurs recherchent des opportunités sous-évaluées. Cutoshi, une nouvelle pièce mème prometteuse sur la blockchain Ethereum, est devenue un joyau caché potentiel.

-

- Pourquoi des troupeaux d'investisseurs adoptent Moodeng ETH plutôt que Shiba Inu et Brett Coin, qui étaient d'anciens favoris du marché

- Oct 03, 2024 at 04:25 pm

- Si vous aviez la chance d'être l'un des premiers investisseurs en prévente Floki Inu, Dogecoin ou Shiba Inu, vous auriez réalisé des millions de bénéfices.

-

- Quelle est la prochaine étape pour Ripple après l'appel de la SEC ? Le prix du XRP va-t-il s’effondrer ?

- Oct 03, 2024 at 04:25 pm

- La Securities and Exchange Commission des États-Unis a annoncé hier qu'elle ferait appel de la décision de la juge Analisa Torres, qui a donné à XRP une victoire contre eux. L'avis d'appel a été déposé hier.

-

- Les analystes de Swyftx se penchent sur les mouvements récents du marché de la cryptographie et révèlent les facteurs à l'origine de la pompe dans le secteur Memecoin et d'autres grands gagnants cette semaine

- Oct 03, 2024 at 04:25 pm

- Les analystes de Swyftx se sont plongés dans les mouvements récents du marché de la cryptographie, révélant les facteurs à l'origine de la récente poussée dans le secteur des memecoins et d'autres.

-

- Vérifiez votre monnaie ! Une pièce rare de 20 pence de 2008 se vend 780 £ sur eBay – 390 fois sa valeur nominale

- Oct 03, 2024 at 04:25 pm

- Nous sommes tous encouragés à vérifier notre monnaie après qu'une pièce rare de 20 pence ait été vendue 390 fois sa valeur nominale cette semaine. La pièce de 20 pence est une pièce « mule » datant de 2008 et a été frappée sans date sur la pièce en raison d'une erreur.

-