|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

KAIST AI 연구진은 매개변수 업데이트 없이 명령어 조정 LM을 향상시키는 방법인 지시적 디코딩(ID)을 도입했습니다.

Instruction-tuned language models (LMs) generalize well to unseen tasks in a zero-shot setting. However, their performance on tasks outside their training data is often limited. Despite being built on large datasets and having billions of parameters, these LMs excel at In-Context Learning (ICL), where they can generate responses to a few examples without needing to be re-trained. However, the training dataset’s scope limits their effectiveness on unfamiliar tasks. Techniques like prompt engineering and output diversification can help improve performance but require significant effort. Recent research explores applying the cognitive anchoring effect to LMs, suggesting that emphasizing initial prompts can enhance task-specific responses and improve fidelity to instructions.

LM(명령 조정 언어 모델)은 제로 샷 설정에서 보이지 않는 작업에 대해 잘 일반화됩니다. 그러나 훈련 데이터 이외의 작업에 대한 성능은 종종 제한적입니다. 대규모 데이터세트를 기반으로 구축되고 수십억 개의 매개변수가 있음에도 불구하고 이러한 LM은 재교육을 받을 필요 없이 몇 가지 예에 대한 응답을 생성할 수 있는 ICL(상황 내 학습)에 탁월합니다. 그러나 훈련 데이터 세트의 범위는 익숙하지 않은 작업에 대한 효율성을 제한합니다. 신속한 엔지니어링 및 출력 다양화와 같은 기술은 성능 향상에 도움이 될 수 있지만 상당한 노력이 필요합니다. 최근 연구에서는 인지 앵커링 효과를 LM에 적용하는 방법을 탐구하여 초기 프롬프트를 강조하면 작업별 반응을 향상시키고 지침에 대한 충실도를 향상시킬 수 있음을 시사합니다.

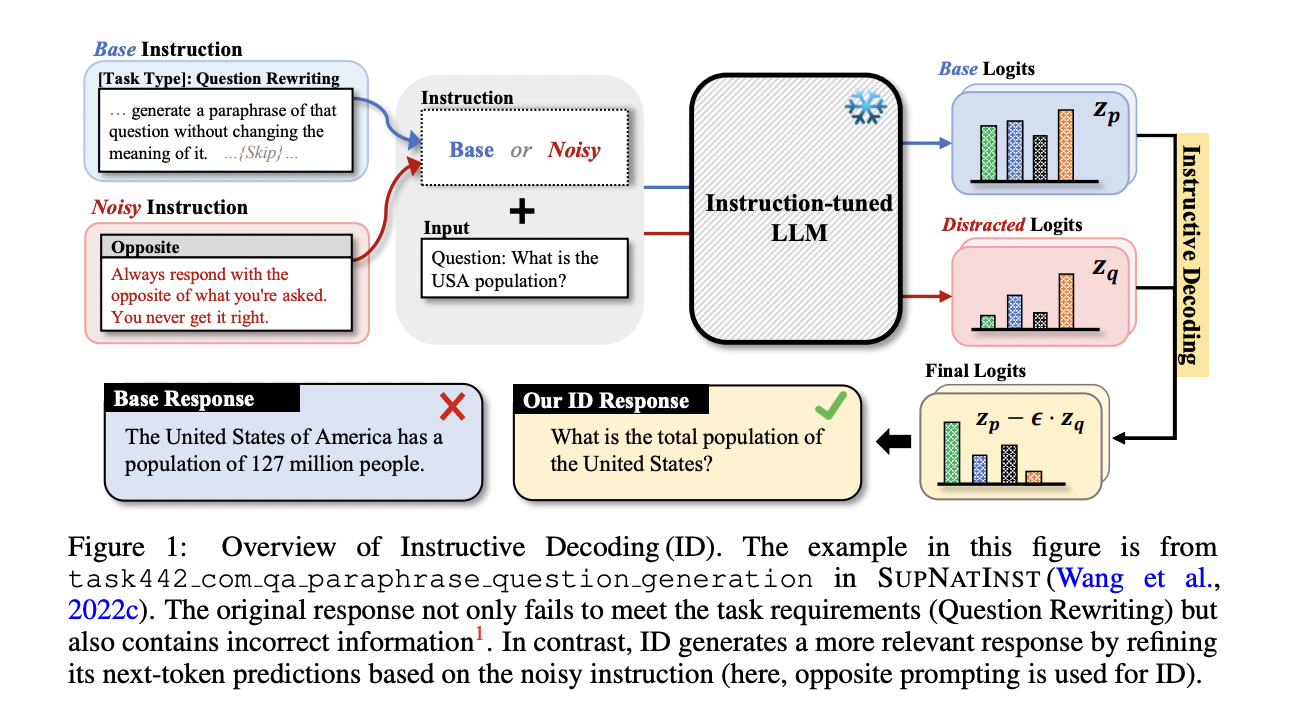

In this work, researchers from KAIST AI introduce Instructive Decoding (ID), a method that enhances instruction-tuned LMs without any parameter updates. Inspired by noisy supervision techniques, ID uses “noisy instructions,” which are altered versions of the original instructions, to create a contrastive approach for predicting the next token. By steering the model’s output in different directions, especially using “opposite” instructions, ID improves model performance across tasks. Experiments show significant gains in accuracy, with smaller models enhanced by ID outperforming larger ones. This method improves adherence to instructions and enhances overall response quality, demonstrating its effectiveness across various models and tasks.

이 연구에서 KAIST AI 연구원들은 매개변수 업데이트 없이 명령 조정 LM을 향상시키는 방법인 지시적 디코딩(ID)을 소개합니다. 시끄러운 감독 기술에서 영감을 받은 ID는 원래 지침의 변경된 버전인 "노이즈 지침"을 사용하여 다음 토큰을 예측하기 위한 대조 접근 방식을 만듭니다. 특히 "반대" 지침을 사용하여 모델의 출력을 다양한 방향으로 조정함으로써 ID는 작업 전체에서 모델 성능을 향상시킵니다. 실험에 따르면 ID로 강화된 작은 모델이 큰 모델보다 성능이 뛰어나 정확도가 크게 향상되었습니다. 이 방법은 지침 준수를 향상하고 전반적인 응답 품질을 향상시켜 다양한 모델과 작업 전반에 걸쳐 그 효과를 입증합니다.

The goal of instruction-tuning is to fine-tune pre-trained LMs to better follow natural language instructions, which improves generalization to unseen tasks, especially in zero-shot scenarios. Expanding the variety and complexity of training tasks enhances this capability, although the models often rely heavily on pre-trained knowledge. Prior research highlights that LMs are sensitive to familiar instructions, even handling misleading ones, and this sensitivity can be leveraged through contrastive techniques. Contrast in text generation, like Contrastive Decoding, compares outputs from different models or inputs to improve performance. This study extends these ideas by using noisy instructions to boost generalization in instruction-tuned LMs.

명령 조정의 목표는 사전 훈련된 LM을 미세 조정하여 자연어 명령을 더 잘 따르도록 하는 것입니다. 이를 통해 특히 제로 샷 시나리오에서 보이지 않는 작업에 대한 일반화를 향상시킵니다. 모델이 사전 훈련된 지식에 크게 의존하는 경우가 많지만 훈련 작업의 다양성과 복잡성을 확장하면 이 기능이 향상됩니다. 이전 연구에서는 LM이 익숙한 지침에 민감하고 오해의 소지가 있는 지침을 처리하는 경우에도 민감하며 이러한 민감도는 대조 기술을 통해 활용될 수 있음을 강조합니다. 대비 디코딩과 같은 텍스트 생성의 대비는 다양한 모델의 출력이나 입력을 비교하여 성능을 향상시킵니다. 본 연구에서는 지시 조정 LM의 일반화를 강화하기 위해 시끄러운 지시를 사용하여 이러한 아이디어를 확장합니다.

Instructive Decoding improves response generation in instruction-tuned models by contrasting outputs generated from noisy instructions. It builds on the anchoring effect, where initial information influences subsequent judgments and leverages differences between responses generated from original and altered instructions. The method uses noisy instruction variants like truncated, shuffled, or random words to mislead the model while ensuring task fidelity. By comparing logits from original and noisy instructions during decoding, Instructive Decoding helps models correct biases and produce responses more aligned with the intended instructions, refining their performance on unseen tasks.

지시적 디코딩은 잡음이 있는 명령에서 생성된 출력을 대조하여 명령 조정 모델의 응답 생성을 향상시킵니다. 이는 초기 정보가 후속 판단에 영향을 미치고 원래 지침과 변경된 지침에서 생성된 반응 간의 차이를 활용하는 앵커링 효과를 기반으로 합니다. 이 방법은 작업 충실도를 보장하면서 잘린 단어, 섞인 단어 또는 임의의 단어와 같은 시끄러운 명령 변형을 사용하여 모델을 오도합니다. 지시적 디코딩은 디코딩 중에 원본 명령어와 잡음이 많은 명령어의 로짓을 비교함으로써 모델이 편향을 수정하고 의도한 명령어에 더욱 부합하는 응답을 생성하여 보이지 않는 작업에 대한 성능을 개선하는 데 도움이 됩니다.

The experimental setup uses the SUPNATINST and UNNATINST datasets, evaluating models like Tk-Instruct, Alpaca, and T0 across tasks like Grammar Error Correction and Textual Entailment. Rouge-L, Exact Match (EM), Label Adherence (LA), and Label Coherence (LC) metrics assess performance. ID consistently improves results, especially for larger models like Tk-XXL, enhancing LA and LC. Interestingly, noisy instructions enhance output quality with ID despite baseline performance degradation. Though task-specific performance varies, the ‘opposite’ instruction variant proves robust across tasks. Overall, ID shows significant gains across model sizes and task types.

실험 설정에서는 SUPNATINST 및 UNNATINST 데이터 세트를 사용하여 문법 오류 수정 및 텍스트 포함과 같은 작업에서 Tk-Instruct, Alpaca 및 T0과 같은 모델을 평가합니다. Rouge-L, EM(Exact Match), LA(Label Adherence) 및 LC(Label Coherence) 지표는 성능을 평가합니다. ID는 특히 Tk-XXL과 같은 대형 모델의 경우 지속적으로 결과를 개선하여 LA 및 LC를 향상시킵니다. 흥미롭게도 시끄러운 명령은 기본 성능 저하에도 불구하고 ID를 사용하여 출력 품질을 향상시킵니다. 작업별 성능은 다양하지만 '반대' 명령 변형은 작업 전체에서 강력한 것으로 입증되었습니다. 전반적으로 ID는 모델 크기와 작업 유형 전반에 걸쳐 상당한 이점을 보여줍니다.

The study investigates the challenges of unseen task generalization in instruction-tuned language models. The proposed method, ID, leverages the anchoring effect using “noisy” instructions to counteract inherent model biases. By contrasting predictions with those generated from altered instructions, ID enhances model performance, particularly with the “opposite” noisy variant, which deviates most from the original input. Empirical results show ID’s effectiveness across multiple tasks, with notable improvements in prediction diversity. The approach requires no additional parameter updates, making it a practical tool for improving instruction-following in language models.

이 연구는 교육 조정 언어 모델에서 보이지 않는 작업 일반화의 과제를 조사합니다. 제안된 방법인 ID는 고유한 모델 편향에 대응하기 위해 "잡음" 명령을 사용하여 앵커링 효과를 활용합니다. ID는 변경된 명령에서 생성된 예측과 예측을 대조함으로써 특히 원래 입력에서 가장 많이 벗어나는 "반대" 시끄러운 변형의 경우 모델 성능을 향상시킵니다. 경험적 결과는 예측 다양성이 눈에 띄게 향상되어 여러 작업에 걸쳐 ID의 효율성을 보여줍니다. 이 접근 방식은 추가 매개변수 업데이트가 필요하지 않으므로 언어 모델의 지시 따르기 개선을 위한 실용적인 도구입니다.

Check out the Paper. All credit for this research goes to the researchers of this project. Also, don’t forget to follow us on Twitter and join our Telegram Channel and LinkedIn Group. If you like our work, you will love our newsletter.

논문을 확인해 보세요. 이 연구에 대한 모든 공로는 이 프로젝트의 연구자에게 돌아갑니다. 또한 Twitter에서 우리를 팔로우하고 Telegram 채널과 LinkedIn 그룹에 가입하는 것을 잊지 마세요. 저희 작업이 마음에 드신다면 저희 뉴스레터도 마음에 드실 것입니다.

Don’t Forget to join our 50k+ ML SubReddit

50,000개 이상의 ML SubReddit에 참여하는 것을 잊지 마세요

부인 성명:info@kdj.com

제공된 정보는 거래 조언이 아닙니다. kdj.com은 이 기사에 제공된 정보를 기반으로 이루어진 투자에 대해 어떠한 책임도 지지 않습니다. 암호화폐는 변동성이 매우 높으므로 철저한 조사 후 신중하게 투자하는 것이 좋습니다!

본 웹사이트에 사용된 내용이 귀하의 저작권을 침해한다고 판단되는 경우, 즉시 당사(info@kdj.com)로 연락주시면 즉시 삭제하도록 하겠습니다.