|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

KAIST AI の研究者は、パラメータを更新せずに命令調整された LM を強化する手法である命令デコーディング (ID) を導入しました。

Instruction-tuned language models (LMs) generalize well to unseen tasks in a zero-shot setting. However, their performance on tasks outside their training data is often limited. Despite being built on large datasets and having billions of parameters, these LMs excel at In-Context Learning (ICL), where they can generate responses to a few examples without needing to be re-trained. However, the training dataset’s scope limits their effectiveness on unfamiliar tasks. Techniques like prompt engineering and output diversification can help improve performance but require significant effort. Recent research explores applying the cognitive anchoring effect to LMs, suggesting that emphasizing initial prompts can enhance task-specific responses and improve fidelity to instructions.

命令調整言語モデル (LM) は、ゼロショット設定で目に見えないタスクをうまく一般化します。ただし、トレーニング データ以外のタスクでのパフォーマンスは制限されることがよくあります。これらの LM は、大規模なデータセットに基づいて構築されており、数十億のパラメーターを持っているにもかかわらず、コンテキスト内学習 (ICL) に優れており、再トレーニングすることなく、いくつかの例に対する応答を生成できます。ただし、トレーニング データセットの範囲により、不慣れなタスクに対する有効性は制限されます。迅速なエンジニアリングや出力の多様化などの手法はパフォーマンスの向上に役立ちますが、多大な労力が必要です。最近の研究では、認知アンカリング効果をLMに適用することが検討されており、最初のプロンプトを強調することでタスク固有の反応が強化され、指示に対する忠実度が向上する可能性があることが示唆されています。

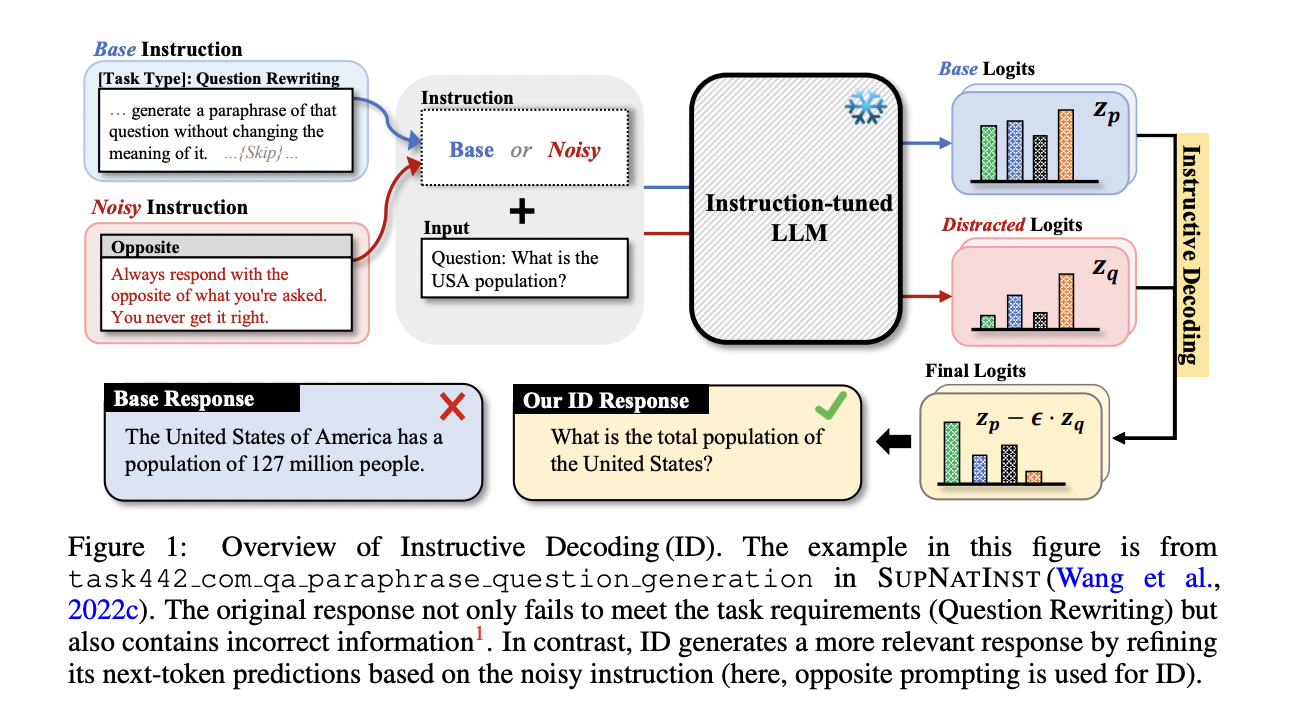

In this work, researchers from KAIST AI introduce Instructive Decoding (ID), a method that enhances instruction-tuned LMs without any parameter updates. Inspired by noisy supervision techniques, ID uses “noisy instructions,” which are altered versions of the original instructions, to create a contrastive approach for predicting the next token. By steering the model’s output in different directions, especially using “opposite” instructions, ID improves model performance across tasks. Experiments show significant gains in accuracy, with smaller models enhanced by ID outperforming larger ones. This method improves adherence to instructions and enhances overall response quality, demonstrating its effectiveness across various models and tasks.

この研究では、KAIST AI の研究者が、パラメータを更新せずに命令調整された LM を強化する手法である命令デコーディング (ID) を導入しました。ノイズのある監視手法に触発された ID は、元の命令を変更したバージョンである「ノイズのある命令」を使用して、次のトークンを予測するための対照的なアプローチを作成します。 ID は、特に「反対の」命令を使用して、モデルの出力をさまざまな方向に操作することにより、タスク全体でモデルのパフォーマンスを向上させます。実験では、ID によって強化された小型モデルの方が大型モデルよりも優れた精度の大幅な向上を示しました。この方法により、指示への遵守が向上し、全体的な応答品質が向上し、さまざまなモデルやタスクにわたってその有効性が実証されます。

The goal of instruction-tuning is to fine-tune pre-trained LMs to better follow natural language instructions, which improves generalization to unseen tasks, especially in zero-shot scenarios. Expanding the variety and complexity of training tasks enhances this capability, although the models often rely heavily on pre-trained knowledge. Prior research highlights that LMs are sensitive to familiar instructions, even handling misleading ones, and this sensitivity can be leveraged through contrastive techniques. Contrast in text generation, like Contrastive Decoding, compares outputs from different models or inputs to improve performance. This study extends these ideas by using noisy instructions to boost generalization in instruction-tuned LMs.

命令チューニングの目標は、事前トレーニングされた LM を微調整して、自然言語命令によりよく従うようにすることです。これにより、特にゼロショット シナリオにおいて、目に見えないタスクへの一般化が向上します。トレーニング タスクの多様性と複雑さを拡大することでこの機能が強化されますが、モデルは事前にトレーニングされた知識に大きく依存することがよくあります。これまでの研究では、LM は見慣れた命令に対して敏感であり、たとえ誤解を招くような命令にも敏感であり、この敏感さは対照的な手法によって活用できることが明らかになりました。テキスト生成のコントラストは、コントラスト デコーディングと同様に、異なるモデルまたは入力からの出力を比較してパフォーマンスを向上させます。この研究では、ノイズの多い命令を使用して命令調整された LM の一般化を促進することで、これらのアイデアを拡張します。

Instructive Decoding improves response generation in instruction-tuned models by contrasting outputs generated from noisy instructions. It builds on the anchoring effect, where initial information influences subsequent judgments and leverages differences between responses generated from original and altered instructions. The method uses noisy instruction variants like truncated, shuffled, or random words to mislead the model while ensuring task fidelity. By comparing logits from original and noisy instructions during decoding, Instructive Decoding helps models correct biases and produce responses more aligned with the intended instructions, refining their performance on unseen tasks.

命令デコーディングは、ノイズの多い命令から生成された出力を対比することにより、命令調整モデルでの応答生成を改善します。これは、最初の情報がその後の判断に影響を与え、元の指示と変更された指示から生成された応答の違いを活用するアンカリング効果に基づいています。この方法では、タスクの忠実性を確保しながら、切り捨てられた単語、シャッフルされた単語、またはランダムな単語などのノイズの多い命令の変形を使用して、モデルを誤解させます。インストラクティブ デコーディングは、デコード中に元の命令とノイズのある命令のロジットを比較することで、モデルのバイアスを修正し、意図された命令により一致した応答を生成し、目に見えないタスクでのパフォーマンスを向上させるのに役立ちます。

The experimental setup uses the SUPNATINST and UNNATINST datasets, evaluating models like Tk-Instruct, Alpaca, and T0 across tasks like Grammar Error Correction and Textual Entailment. Rouge-L, Exact Match (EM), Label Adherence (LA), and Label Coherence (LC) metrics assess performance. ID consistently improves results, especially for larger models like Tk-XXL, enhancing LA and LC. Interestingly, noisy instructions enhance output quality with ID despite baseline performance degradation. Though task-specific performance varies, the ‘opposite’ instruction variant proves robust across tasks. Overall, ID shows significant gains across model sizes and task types.

実験セットアップでは SUPNATINST および UNNATINST データセットを使用し、文法エラー修正やテキスト含意などのタスクにわたって Tk-Instruct、Alpaca、T0 などのモデルを評価します。 Rouge-L、Exact Match (EM)、Label Adherence (LA)、Label Coherence (LC) メトリックによってパフォーマンスを評価します。 ID は、特に Tk-XXL のような大型モデルの結果を一貫して改善し、LA と LC を強化します。興味深いことに、ベースラインのパフォーマンスが低下しているにもかかわらず、ノイズの多い命令により ID による出力品質が向上します。タスク固有のパフォーマンスは異なりますが、「反対の」命令バリアントはタスク間で堅牢であることが証明されています。全体として、ID はモデルのサイズとタスクの種類全体で大幅な向上を示しています。

The study investigates the challenges of unseen task generalization in instruction-tuned language models. The proposed method, ID, leverages the anchoring effect using “noisy” instructions to counteract inherent model biases. By contrasting predictions with those generated from altered instructions, ID enhances model performance, particularly with the “opposite” noisy variant, which deviates most from the original input. Empirical results show ID’s effectiveness across multiple tasks, with notable improvements in prediction diversity. The approach requires no additional parameter updates, making it a practical tool for improving instruction-following in language models.

この研究では、命令調整型言語モデルにおける目に見えないタスクの一般化の課題を調査しています。提案された方法 ID は、「ノイズの多い」命令を使用したアンカリング効果を利用して、固有のモデルのバイアスを打ち消します。 ID は、変更された命令から生成された予測と比較することで、特に元の入力から最も逸脱する「反対の」ノイズの多いバリアントでのモデルのパフォーマンスを向上させます。実証結果では、複数のタスクにわたる ID の有効性が示されており、予測の多様性が顕著に向上しています。このアプローチでは追加のパラメーター更新が必要ないため、言語モデルでの命令追従を改善するための実用的なツールになります。

Check out the Paper. All credit for this research goes to the researchers of this project. Also, don’t forget to follow us on Twitter and join our Telegram Channel and LinkedIn Group. If you like our work, you will love our newsletter.

論文をチェックしてください。この研究の功績はすべて、このプロジェクトの研究者に与えられます。また、Twitter で私たちをフォローし、Telegram チャンネルと LinkedIn グループに参加することを忘れないでください。私たちの仕事が気に入ったら、ニュースレターも気に入っていただけるでしょう。

Don’t Forget to join our 50k+ ML SubReddit

50,000 以上の ML SubReddit に忘れずに参加してください

免責事項:info@kdj.com

提供される情報は取引に関するアドバイスではありません。 kdj.com は、この記事で提供される情報に基づいて行われた投資に対して一切の責任を負いません。暗号通貨は変動性が高いため、十分な調査を行った上で慎重に投資することを強くお勧めします。

このウェブサイトで使用されているコンテンツが著作権を侵害していると思われる場合は、直ちに当社 (info@kdj.com) までご連絡ください。速やかに削除させていただきます。