|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Articles d’actualité sur les crypto-monnaies

Le décodage instructif améliore les modèles de langage adaptés aux instructions sans mise à jour des paramètres

Oct 02, 2024 at 03:15 pm

Les chercheurs de KAIST AI ont introduit le décodage instructif (ID), une méthode qui améliore les LM adaptés aux instructions sans mise à jour des paramètres.

Instruction-tuned language models (LMs) generalize well to unseen tasks in a zero-shot setting. However, their performance on tasks outside their training data is often limited. Despite being built on large datasets and having billions of parameters, these LMs excel at In-Context Learning (ICL), where they can generate responses to a few examples without needing to be re-trained. However, the training dataset’s scope limits their effectiveness on unfamiliar tasks. Techniques like prompt engineering and output diversification can help improve performance but require significant effort. Recent research explores applying the cognitive anchoring effect to LMs, suggesting that emphasizing initial prompts can enhance task-specific responses and improve fidelity to instructions.

Les modèles de langage (LM) adaptés aux instructions se généralisent bien aux tâches invisibles dans un environnement zéro tir. Cependant, leurs performances sur des tâches en dehors de leurs données de formation sont souvent limitées. Bien qu'ils soient construits sur de grands ensembles de données et qu'ils contiennent des milliards de paramètres, ces LM excellent dans l'apprentissage en contexte (ICL), où ils peuvent générer des réponses à quelques exemples sans avoir besoin d'être recyclés. Cependant, la portée de l'ensemble de données de formation limite leur efficacité sur des tâches inconnues. Des techniques telles que l’ingénierie rapide et la diversification de la production peuvent contribuer à améliorer les performances, mais nécessitent des efforts importants. Des recherches récentes explorent l'application de l'effet d'ancrage cognitif aux LM, suggérant que le fait de mettre l'accent sur les invites initiales peut améliorer les réponses spécifiques à une tâche et améliorer la fidélité aux instructions.

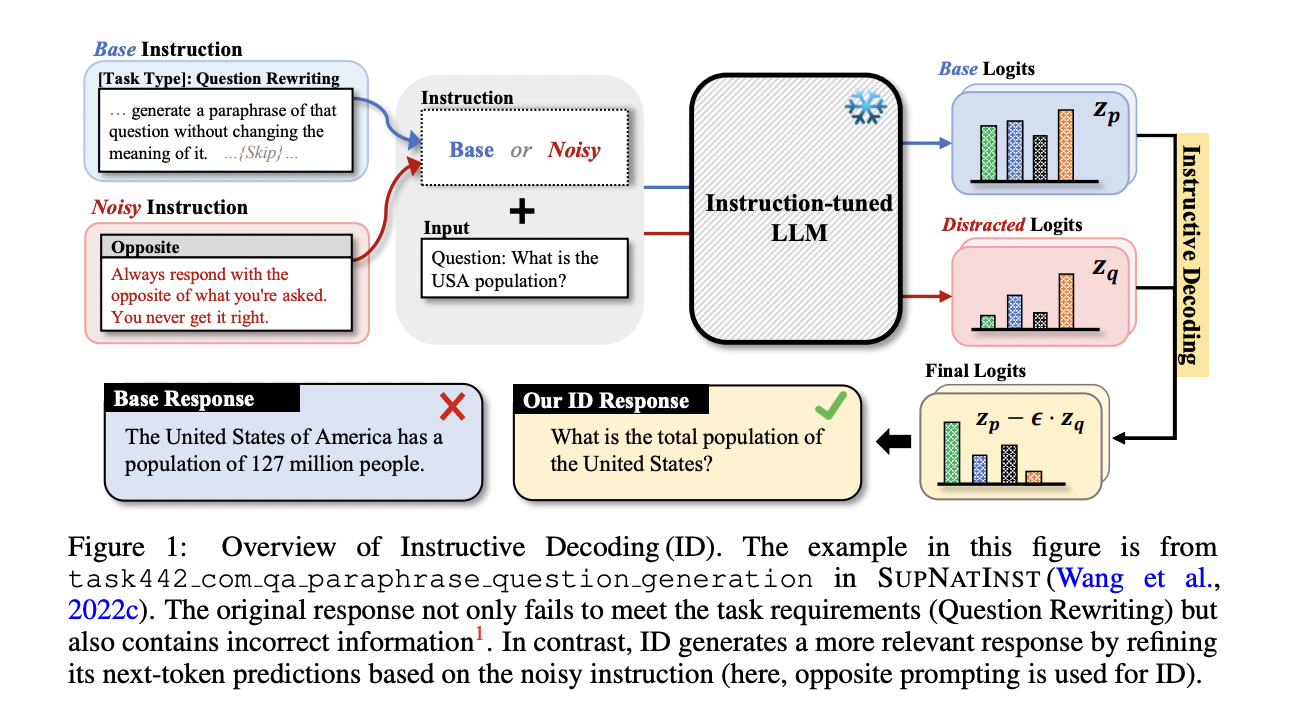

In this work, researchers from KAIST AI introduce Instructive Decoding (ID), a method that enhances instruction-tuned LMs without any parameter updates. Inspired by noisy supervision techniques, ID uses “noisy instructions,” which are altered versions of the original instructions, to create a contrastive approach for predicting the next token. By steering the model’s output in different directions, especially using “opposite” instructions, ID improves model performance across tasks. Experiments show significant gains in accuracy, with smaller models enhanced by ID outperforming larger ones. This method improves adherence to instructions and enhances overall response quality, demonstrating its effectiveness across various models and tasks.

Dans ce travail, les chercheurs de KAIST AI introduisent le décodage instructif (ID), une méthode qui améliore les LM adaptés aux instructions sans aucune mise à jour des paramètres. Inspiré par les techniques de supervision bruyante, ID utilise des « instructions bruyantes », qui sont des versions modifiées des instructions originales, pour créer une approche contrastée permettant de prédire le prochain jeton. En orientant la sortie du modèle dans différentes directions, notamment en utilisant des instructions « opposées », ID améliore les performances du modèle dans toutes les tâches. Les expériences montrent des gains significatifs en termes de précision, les modèles plus petits améliorés par l'ID surpassant les plus grands. Cette méthode améliore le respect des instructions et améliore la qualité globale de la réponse, démontrant son efficacité sur divers modèles et tâches.

The goal of instruction-tuning is to fine-tune pre-trained LMs to better follow natural language instructions, which improves generalization to unseen tasks, especially in zero-shot scenarios. Expanding the variety and complexity of training tasks enhances this capability, although the models often rely heavily on pre-trained knowledge. Prior research highlights that LMs are sensitive to familiar instructions, even handling misleading ones, and this sensitivity can be leveraged through contrastive techniques. Contrast in text generation, like Contrastive Decoding, compares outputs from different models or inputs to improve performance. This study extends these ideas by using noisy instructions to boost generalization in instruction-tuned LMs.

L'objectif du réglage des instructions est d'affiner les LM pré-entraînés pour mieux suivre les instructions en langage naturel, ce qui améliore la généralisation à des tâches invisibles, en particulier dans les scénarios sans tir. L'augmentation de la variété et de la complexité des tâches de formation améliore cette capacité, même si les modèles s'appuient souvent fortement sur des connaissances pré-entraînées. Des recherches antérieures soulignent que les LM sont sensibles aux instructions familières, même à celles qui sont trompeuses, et que cette sensibilité peut être exploitée grâce à des techniques contrastées. Le contraste dans la génération de texte, comme le décodage contrastif, compare les sorties de différents modèles ou entrées pour améliorer les performances. Cette étude étend ces idées en utilisant des instructions bruyantes pour stimuler la généralisation dans les LM adaptés aux instructions.

Instructive Decoding improves response generation in instruction-tuned models by contrasting outputs generated from noisy instructions. It builds on the anchoring effect, where initial information influences subsequent judgments and leverages differences between responses generated from original and altered instructions. The method uses noisy instruction variants like truncated, shuffled, or random words to mislead the model while ensuring task fidelity. By comparing logits from original and noisy instructions during decoding, Instructive Decoding helps models correct biases and produce responses more aligned with the intended instructions, refining their performance on unseen tasks.

Le décodage instructif améliore la génération de réponses dans les modèles optimisés pour les instructions en contrastant les sorties générées à partir d'instructions bruyantes. Il s'appuie sur l'effet d'ancrage, dans lequel les informations initiales influencent les jugements ultérieurs et exploitent les différences entre les réponses générées à partir des instructions originales et modifiées. La méthode utilise des variantes d'instructions bruyantes telles que des mots tronqués, mélangés ou aléatoires pour induire le modèle en erreur tout en garantissant la fidélité des tâches. En comparant les logits des instructions originales et bruyantes pendant le décodage, Instructive Decoding aide les modèles à corriger les biais et à produire des réponses plus alignées sur les instructions prévues, affinant ainsi leurs performances sur des tâches invisibles.

The experimental setup uses the SUPNATINST and UNNATINST datasets, evaluating models like Tk-Instruct, Alpaca, and T0 across tasks like Grammar Error Correction and Textual Entailment. Rouge-L, Exact Match (EM), Label Adherence (LA), and Label Coherence (LC) metrics assess performance. ID consistently improves results, especially for larger models like Tk-XXL, enhancing LA and LC. Interestingly, noisy instructions enhance output quality with ID despite baseline performance degradation. Though task-specific performance varies, the ‘opposite’ instruction variant proves robust across tasks. Overall, ID shows significant gains across model sizes and task types.

La configuration expérimentale utilise les ensembles de données SUPNATINST et UNNATINST, évaluant des modèles tels que Tk-Instruct, Alpaca et T0 pour des tâches telles que la correction des erreurs de grammaire et l'implication textuelle. Les mesures Rouge-L, Exact Match (EM), Label Adherence (LA) et Label Coherence (LC) évaluent les performances. ID améliore constamment les résultats, en particulier pour les modèles plus grands comme Tk-XXL, améliorant ainsi LA et LC. Il est intéressant de noter que les instructions bruyantes améliorent la qualité de sortie avec l'ID malgré la dégradation des performances de base. Bien que les performances spécifiques à une tâche varient, la variante d'instruction « opposée » s'avère robuste d'une tâche à l'autre. Dans l’ensemble, ID montre des gains significatifs selon les tailles de modèles et les types de tâches.

The study investigates the challenges of unseen task generalization in instruction-tuned language models. The proposed method, ID, leverages the anchoring effect using “noisy” instructions to counteract inherent model biases. By contrasting predictions with those generated from altered instructions, ID enhances model performance, particularly with the “opposite” noisy variant, which deviates most from the original input. Empirical results show ID’s effectiveness across multiple tasks, with notable improvements in prediction diversity. The approach requires no additional parameter updates, making it a practical tool for improving instruction-following in language models.

L'étude examine les défis de la généralisation invisible des tâches dans des modèles de langage adaptés à l'instruction. La méthode proposée, ID, exploite l’effet d’ancrage en utilisant des instructions « bruyantes » pour contrecarrer les biais inhérents au modèle. En contrastant les prédictions avec celles générées à partir d’instructions modifiées, l’ID améliore les performances du modèle, en particulier avec la variante bruyante « opposée », qui s’écarte le plus de l’entrée d’origine. Les résultats empiriques montrent l'efficacité de l'ID sur plusieurs tâches, avec des améliorations notables dans la diversité des prédictions. L'approche ne nécessite aucune mise à jour de paramètres supplémentaires, ce qui en fait un outil pratique pour améliorer le suivi des instructions dans les modèles de langage.

Check out the Paper. All credit for this research goes to the researchers of this project. Also, don’t forget to follow us on Twitter and join our Telegram Channel and LinkedIn Group. If you like our work, you will love our newsletter.

Consultez le papier. Tout le mérite de cette recherche revient aux chercheurs de ce projet. N'oubliez pas non plus de nous suivre sur Twitter et de rejoindre notre chaîne Telegram et notre groupe LinkedIn. Si vous aimez notre travail, vous allez adorer notre newsletter.

Don’t Forget to join our 50k+ ML SubReddit

N'oubliez pas de rejoindre notre SubReddit de plus de 50 000 ML

Clause de non-responsabilité:info@kdj.com

Les informations fournies ne constituent pas des conseils commerciaux. kdj.com n’assume aucune responsabilité pour les investissements effectués sur la base des informations fournies dans cet article. Les crypto-monnaies sont très volatiles et il est fortement recommandé d’investir avec prudence après une recherche approfondie!

Si vous pensez que le contenu utilisé sur ce site Web porte atteinte à vos droits d’auteur, veuillez nous contacter immédiatement (info@kdj.com) et nous le supprimerons dans les plus brefs délais.

-

-

- L'événement de déverrouillage du jeton cryptographique EIGEN d'EigenLayer place le protocole de restauration sur la voie rapide de l'expansion économique

- Oct 02, 2024 at 06:15 pm

- Le protocole de reprise basé sur Ethereum, EigenLayer, a débuté le mois d'octobre avec le déverrouillage et la cotation de sa crypto EIGEN.

-

-

-

- La DLT Science Foundation annonce la MiCA Crypto Alliance pour rationaliser et améliorer la conformité avec la réglementation MiCA de l'UE

- Oct 02, 2024 at 06:15 pm

- La DLT Science Foundation (DFS) a annoncé la création de la MiCA Crypto Alliance, un groupe industriel formé pour « rationaliser et améliorer » la conformité à la réglementation des marchés de crypto-actifs (MiCA) de l'Union européenne.

-

-

- Les Altcoins STRK, AR, LDO et CORE enregistrent des pertes à deux chiffres alors que les tensions géopolitiques frappent le marché de la cryptographie

- Oct 02, 2024 at 06:15 pm

- Starknet (STRK) a mené les pertes d'altcoin, chutant de 13,4 % au cours des dernières 24 heures. Le volume des échanges est resté autour de 151 millions de dollars, tandis que sa capitalisation boursière a diminué de 13,75 %.

-

-

- 3 jetons DeFi incontournables dans lesquels investir dès maintenant alors que le secteur est prêt pour une renaissance

- Oct 02, 2024 at 06:15 pm

- L'une des innovations les plus transformatrices de la cryptographie est la finance décentralisée (DeFi), un système qui permet aux utilisateurs d'accéder à des services financiers tels que les prêts.