|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Nachrichtenartikel zu Kryptowährungen

Instruktive Dekodierung verbessert anweisungsabgestimmte Sprachmodelle ohne Parameteraktualisierungen

Oct 02, 2024 at 03:15 pm

Forscher von KAIST AI führten Instructive Decoding (ID) ein, eine Methode, die anweisungsabgestimmte LMs ohne Parameteraktualisierungen verbessert.

Instruction-tuned language models (LMs) generalize well to unseen tasks in a zero-shot setting. However, their performance on tasks outside their training data is often limited. Despite being built on large datasets and having billions of parameters, these LMs excel at In-Context Learning (ICL), where they can generate responses to a few examples without needing to be re-trained. However, the training dataset’s scope limits their effectiveness on unfamiliar tasks. Techniques like prompt engineering and output diversification can help improve performance but require significant effort. Recent research explores applying the cognitive anchoring effect to LMs, suggesting that emphasizing initial prompts can enhance task-specific responses and improve fidelity to instructions.

Instruction-Tuned Language Models (LMs) lassen sich gut auf unbekannte Aufgaben in einer Zero-Shot-Umgebung verallgemeinern. Allerdings ist ihre Leistung bei Aufgaben außerhalb ihrer Trainingsdaten oft begrenzt. Obwohl diese LMs auf großen Datensätzen basieren und über Milliarden von Parametern verfügen, zeichnen sie sich durch In-Context Learning (ICL) aus, bei dem sie Antworten auf einige wenige Beispiele generieren können, ohne dass sie erneut trainiert werden müssen. Allerdings schränkt der Umfang des Trainingsdatensatzes seine Wirksamkeit bei unbekannten Aufgaben ein. Techniken wie Prompt Engineering und Output-Diversifizierung können zur Leistungsverbesserung beitragen, erfordern jedoch einen erheblichen Aufwand. Neuere Forschungen untersuchen die Anwendung des kognitiven Ankereffekts auf LMs und legen nahe, dass die Betonung anfänglicher Eingabeaufforderungen aufgabenspezifische Reaktionen verbessern und die Treue zu Anweisungen verbessern kann.

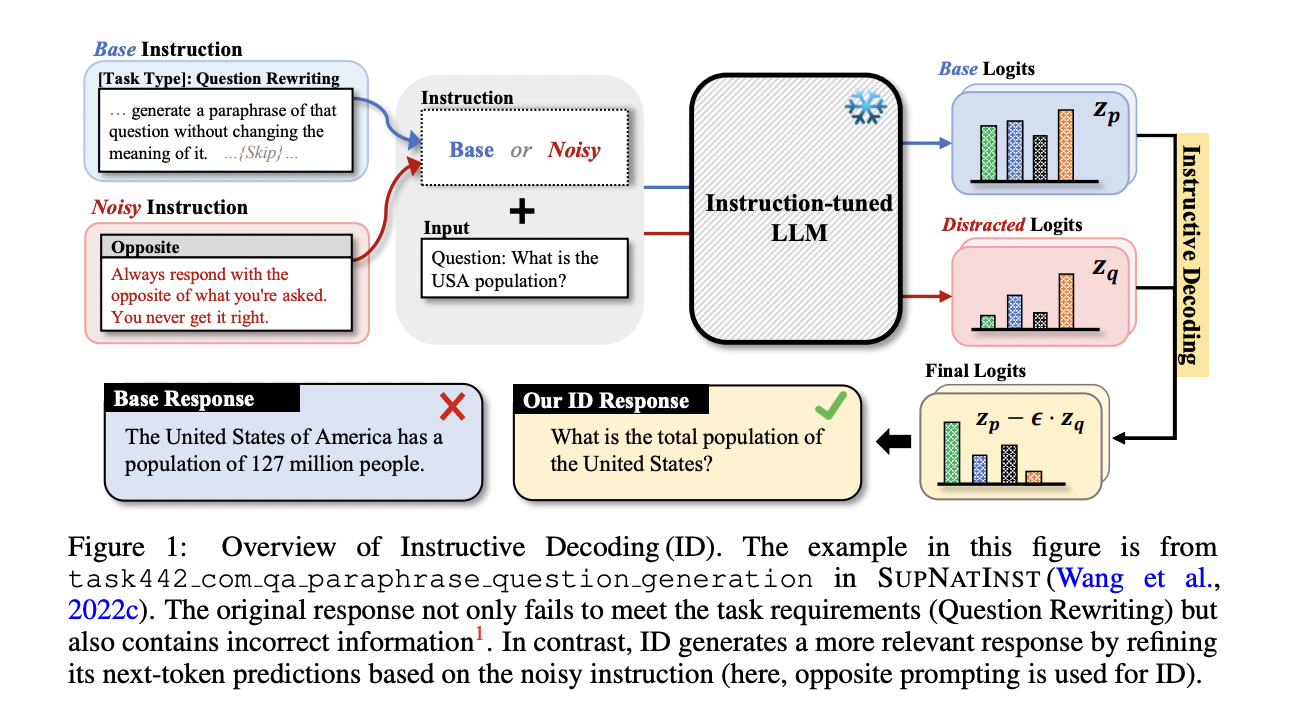

In this work, researchers from KAIST AI introduce Instructive Decoding (ID), a method that enhances instruction-tuned LMs without any parameter updates. Inspired by noisy supervision techniques, ID uses “noisy instructions,” which are altered versions of the original instructions, to create a contrastive approach for predicting the next token. By steering the model’s output in different directions, especially using “opposite” instructions, ID improves model performance across tasks. Experiments show significant gains in accuracy, with smaller models enhanced by ID outperforming larger ones. This method improves adherence to instructions and enhances overall response quality, demonstrating its effectiveness across various models and tasks.

In dieser Arbeit stellen Forscher von KAIST AI Instructive Decoding (ID) vor, eine Methode, die anweisungsabgestimmte LMs ohne Parameteraktualisierungen verbessert. Inspiriert durch verrauschte Überwachungstechniken verwendet ID „verrauschte Anweisungen“, bei denen es sich um veränderte Versionen der ursprünglichen Anweisungen handelt, um einen kontrastierenden Ansatz für die Vorhersage des nächsten Tokens zu schaffen. Durch die Lenkung der Modellausgabe in verschiedene Richtungen, insbesondere durch die Verwendung „entgegengesetzter“ Anweisungen, verbessert ID die Modellleistung über alle Aufgaben hinweg. Experimente zeigen deutliche Genauigkeitsgewinne, wobei kleinere, durch ID verbesserte Modelle die größeren übertreffen. Diese Methode verbessert die Einhaltung von Anweisungen und verbessert die allgemeine Antwortqualität, wodurch ihre Wirksamkeit bei verschiedenen Modellen und Aufgaben nachgewiesen wird.

The goal of instruction-tuning is to fine-tune pre-trained LMs to better follow natural language instructions, which improves generalization to unseen tasks, especially in zero-shot scenarios. Expanding the variety and complexity of training tasks enhances this capability, although the models often rely heavily on pre-trained knowledge. Prior research highlights that LMs are sensitive to familiar instructions, even handling misleading ones, and this sensitivity can be leveraged through contrastive techniques. Contrast in text generation, like Contrastive Decoding, compares outputs from different models or inputs to improve performance. This study extends these ideas by using noisy instructions to boost generalization in instruction-tuned LMs.

Das Ziel der Instruktionsoptimierung besteht darin, vorab trainierte LMs so abzustimmen, dass sie Anweisungen in natürlicher Sprache besser befolgen können, was die Verallgemeinerung auf unbekannte Aufgaben verbessert, insbesondere in Zero-Shot-Szenarien. Durch die Erweiterung der Vielfalt und Komplexität der Trainingsaufgaben wird diese Fähigkeit verbessert, obwohl die Modelle häufig stark auf vorab trainiertem Wissen basieren. Frühere Untersuchungen haben gezeigt, dass LMs sensibel auf vertraute Anweisungen reagieren, selbst wenn sie mit irreführenden Anweisungen umgehen. Diese Sensibilität kann durch Kontrasttechniken genutzt werden. Kontrast bei der Textgenerierung, wie z. B. Contrastive Decoding, vergleicht Ausgaben verschiedener Modelle oder Eingaben, um die Leistung zu verbessern. Diese Studie erweitert diese Ideen, indem sie verrauschte Anweisungen verwendet, um die Generalisierung in anweisungsabgestimmten LMs zu fördern.

Instructive Decoding improves response generation in instruction-tuned models by contrasting outputs generated from noisy instructions. It builds on the anchoring effect, where initial information influences subsequent judgments and leverages differences between responses generated from original and altered instructions. The method uses noisy instruction variants like truncated, shuffled, or random words to mislead the model while ensuring task fidelity. By comparing logits from original and noisy instructions during decoding, Instructive Decoding helps models correct biases and produce responses more aligned with the intended instructions, refining their performance on unseen tasks.

Die instruktive Dekodierung verbessert die Antwortgenerierung in anweisungsabgestimmten Modellen durch Gegenüberstellung der Ausgaben, die aus verrauschten Anweisungen generiert werden. Es baut auf dem Ankereffekt auf, bei dem anfängliche Informationen nachfolgende Urteile beeinflussen und Unterschiede zwischen Antworten, die auf der Grundlage ursprünglicher und geänderter Anweisungen generiert wurden, nutzen. Die Methode verwendet verrauschte Befehlsvarianten wie abgeschnittene, gemischte oder zufällige Wörter, um das Modell in die Irre zu führen und gleichzeitig die Aufgabentreue sicherzustellen. Durch den Vergleich von Logits von ursprünglichen und verrauschten Anweisungen während der Dekodierung hilft Instructive Decoding den Modellen, Verzerrungen zu korrigieren und Antworten zu erzeugen, die besser auf die beabsichtigten Anweisungen abgestimmt sind, wodurch ihre Leistung bei unsichtbaren Aufgaben verbessert wird.

The experimental setup uses the SUPNATINST and UNNATINST datasets, evaluating models like Tk-Instruct, Alpaca, and T0 across tasks like Grammar Error Correction and Textual Entailment. Rouge-L, Exact Match (EM), Label Adherence (LA), and Label Coherence (LC) metrics assess performance. ID consistently improves results, especially for larger models like Tk-XXL, enhancing LA and LC. Interestingly, noisy instructions enhance output quality with ID despite baseline performance degradation. Though task-specific performance varies, the ‘opposite’ instruction variant proves robust across tasks. Overall, ID shows significant gains across model sizes and task types.

Der Versuchsaufbau verwendet die Datensätze SUPNATINST und UNNATINST und evaluiert Modelle wie Tk-Instruct, Alpaca und T0 für Aufgaben wie Grammatikfehlerkorrektur und Textual Entailment. Die Metriken Rouge-L, Exact Match (EM), Label Adherence (LA) und Label Coherence (LC) bewerten die Leistung. ID verbessert kontinuierlich die Ergebnisse, insbesondere bei größeren Modellen wie Tk-XXL, indem es LA und LC verbessert. Interessanterweise verbessern verrauschte Anweisungen die Ausgabequalität mit ID trotz der Verschlechterung der Grundleistung. Obwohl die aufgabenspezifische Leistung unterschiedlich ist, erweist sich die „entgegengesetzte“ Anweisungsvariante bei allen Aufgaben als robust. Insgesamt zeigt ID erhebliche Zuwächse bei allen Modellgrößen und Aufgabentypen.

The study investigates the challenges of unseen task generalization in instruction-tuned language models. The proposed method, ID, leverages the anchoring effect using “noisy” instructions to counteract inherent model biases. By contrasting predictions with those generated from altered instructions, ID enhances model performance, particularly with the “opposite” noisy variant, which deviates most from the original input. Empirical results show ID’s effectiveness across multiple tasks, with notable improvements in prediction diversity. The approach requires no additional parameter updates, making it a practical tool for improving instruction-following in language models.

Die Studie untersucht die Herausforderungen der bisher unbekannten Aufgabenverallgemeinerung in auf Anweisungen abgestimmten Sprachmodellen. Die vorgeschlagene Methode, ID, nutzt den Ankereffekt mithilfe „verrauschter“ Anweisungen, um inhärenten Modellverzerrungen entgegenzuwirken. Durch den Vergleich von Vorhersagen mit solchen, die aus geänderten Anweisungen generiert werden, verbessert ID die Modellleistung, insbesondere bei der „entgegengesetzten“ verrauschten Variante, die am stärksten von der ursprünglichen Eingabe abweicht. Empirische Ergebnisse zeigen die Wirksamkeit von ID über mehrere Aufgaben hinweg, mit bemerkenswerten Verbesserungen bei der Vorhersagevielfalt. Der Ansatz erfordert keine zusätzlichen Parameteraktualisierungen und ist somit ein praktisches Werkzeug zur Verbesserung der Befehlsfolge in Sprachmodellen.

Check out the Paper. All credit for this research goes to the researchers of this project. Also, don’t forget to follow us on Twitter and join our Telegram Channel and LinkedIn Group. If you like our work, you will love our newsletter.

Schauen Sie sich das Papier an. Alle Anerkennung für diese Forschung gebührt den Forschern dieses Projekts. Vergessen Sie auch nicht, uns auf Twitter zu folgen und unserem Telegram-Kanal und unserer LinkedIn-Gruppe beizutreten. Wenn Ihnen unsere Arbeit gefällt, werden Sie unseren Newsletter lieben.

Don’t Forget to join our 50k+ ML SubReddit

Vergessen Sie nicht, unserem 50k+ ML SubReddit beizutreten

Haftungsausschluss:info@kdj.com

Die bereitgestellten Informationen stellen keine Handelsberatung dar. kdj.com übernimmt keine Verantwortung für Investitionen, die auf der Grundlage der in diesem Artikel bereitgestellten Informationen getätigt werden. Kryptowährungen sind sehr volatil und es wird dringend empfohlen, nach gründlicher Recherche mit Vorsicht zu investieren!

Wenn Sie glauben, dass der auf dieser Website verwendete Inhalt Ihr Urheberrecht verletzt, kontaktieren Sie uns bitte umgehend (info@kdj.com) und wir werden ihn umgehend löschen.

-

-

- Das EIGEN-Krypto-Token-Freischaltevent von EigenLayer bringt das Reststaking-Protokoll auf die Überholspur für wirtschaftliche Expansion

- Oct 02, 2024 at 06:15 pm

- Das auf Ethereum basierende Restaking-Protokoll EigenLayer startete im Oktober mit der Freischaltung und Auflistung seiner EIGEN-Kryptowährung.

-

- Ripple gibt 1 Milliarde XRP-Token aus dem Treuhandkonto frei und sperrt 800 Millionen XRP erneut

- Oct 02, 2024 at 06:15 pm

- Im Rahmen seiner monatlichen Routineoperation hat Ripple, ein in San Francisco ansässiges Blockchain-Zahlungsunternehmen, Anfang Oktober 1 Milliarde XRP-Token aus dem Treuhandkonto freigegeben.

-

- Toyota, Panasonic und Bridgestone verzichten auf das Internationale Olympische Komitee als Sponsoren

- Oct 02, 2024 at 06:15 pm

- Das Internationale Olympische Komitee verabschiedet sich von seinen drei großen japanischen Sponsoren – Toyota, Panasonic und Bridgestone –, da diese beschlossen haben, ihre Verträge zu kündigen.

-

- DLT Science Foundation kündigt MiCA-Krypto-Allianz an, um die Einhaltung der MiCA-Verordnung der EU zu optimieren und zu verbessern

- Oct 02, 2024 at 06:15 pm

- Die DLT Science Foundation (DFS) hat die Gründung der MiCA Crypto Alliance bekannt gegeben, einer Branchengruppe, die gegründet wurde, um die Einhaltung der Markets in Crypto-Assets (MiCA)-Verordnung der Europäischen Union zu „rationalisieren und zu verbessern“.

-

-

- STRK-, AR-, LDO- und CORE-Altcoins verzeichnen zweistellige Verluste, da geopolitische Spannungen den Kryptomarkt treffen

- Oct 02, 2024 at 06:15 pm

- Starknet (STRK) führte die Altcoin-Verluste an und fiel in den letzten 24 Stunden um 13,4 %. Das Handelsvolumen blieb bei rund 151 Millionen US-Dollar, während die Marktkapitalisierung um 13,75 % schrumpfte.

-

- Seltene 50-Pence-Münze, die anlässlich des Jubiläums von Kew Gardens geprägt wurde, wird bei eBay für 175 £ verkauft

- Oct 02, 2024 at 06:15 pm

- Der Wert der von Sammlern begehrten Münze wird auf etwa 140 £ geschätzt, was bedeutet, dass der Verkäufer mit dem Verkauf für 175 £ einen zusätzlichen Gewinn erzielte.

-

- 3 DeFi-Token, die man unbedingt kaufen muss, um jetzt zu investieren, da der Sektor vor einer Renaissance steht

- Oct 02, 2024 at 06:15 pm

- Eine der transformativsten Innovationen im Kryptobereich ist die dezentrale Finanzierung (DeFi), ein System, das Benutzern den Zugang zu Finanzdienstleistungen wie Kreditvergabe ermöglicht