|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Articles d’actualité sur les crypto-monnaies

Forçage de diffusion : la prédiction du prochain jeton rencontre la diffusion de la séquence complète

Oct 18, 2024 at 02:59 am

Dans l’air du temps actuel de l’IA, les modèles séquentiels ont gagné en popularité en raison de leur capacité à analyser les données et à prédire la marche à suivre.

Sequence models have become increasingly popular in the AI domain for their ability to analyze data and predict下一步做什么. For instance, you've likely used next-token prediction models like ChatGPT, which anticipate each word (token) in a sequence to form answers to users' queries. There are also full-sequence diffusion models like Sora, which convert words into dazzling, realistic visuals by successively "denoising" an entire video sequence.

Les modèles de séquence sont devenus de plus en plus populaires dans le domaine de l'IA en raison de leur capacité à analyser des données et à prédire des données. Par exemple, vous avez probablement utilisé des modèles de prédiction du jeton suivant comme ChatGPT, qui anticipent chaque mot (jeton) dans une séquence pour former des réponses aux requêtes des utilisateurs. Il existe également des modèles de diffusion en séquence complète comme Sora, qui convertissent les mots en visuels éblouissants et réalistes en « débruitant » successivement une séquence vidéo entière.

Researchers from MIT's Computer Science and Artificial Intelligence Laboratory (CSAIL) have proposed a simple change to the diffusion training scheme that makes this sequence denoising considerably more flexible.

Des chercheurs du laboratoire d'informatique et d'intelligence artificielle (CSAIL) du MIT ont proposé une modification simple du schéma de formation par diffusion qui rend cette séquence de débruitage considérablement plus flexible.

When applied to fields like computer vision and robotics, the next-token and full-sequence diffusion models have capability trade-offs. Next-token models can spit out sequences that vary in length.

Lorsqu’ils sont appliqués à des domaines tels que la vision par ordinateur et la robotique, les modèles de diffusion du jeton suivant et de la séquence complète présentent des compromis en termes de capacités. Les modèles de jetons suivants peuvent cracher des séquences dont la longueur varie.

However, they make these generations while being unaware of desirable states in the far future—such as steering its sequence generation toward a certain goal 10 tokens away—and thus require additional mechanisms for long-horizon (long-term) planning. Diffusion models can perform such future-conditioned sampling, but lack the ability of next-token models to generate variable-length sequences.

Cependant, ils créent ces générations tout en ignorant les états souhaitables dans un avenir lointain – comme orienter leur génération de séquences vers un certain objectif à 10 jetons – et nécessitent donc des mécanismes supplémentaires pour une planification à long terme (à long terme). Les modèles de diffusion peuvent effectuer un tel échantillonnage conditionné dans le futur, mais n'ont pas la capacité des modèles de jeton suivant à générer des séquences de longueur variable.

Researchers from CSAIL want to combine the strengths of both models, so they created a sequence model training technique called "Diffusion Forcing." The name comes from "Teacher Forcing," the conventional training scheme that breaks down full sequence generation into the smaller, easier steps of next-token generation (much like a good teacher simplifying a complex concept).

Les chercheurs du CSAIL souhaitent combiner les atouts des deux modèles. Ils ont donc créé une technique de formation de modèles de séquence appelée « Forçage de diffusion ». Le nom vient de « Teacher Forcing », le programme de formation conventionnel qui décompose la génération de séquences complètes en étapes plus petites et plus faciles de la génération suivante de jetons (un peu comme un bon enseignant simplifiant un concept complexe).

Diffusion Forcing found common ground between diffusion models and teacher forcing: They both use training schemes that involve predicting masked (noisy) tokens from unmasked ones. In the case of diffusion models, they gradually add noise to data, which can be viewed as fractional masking.

Le forçage de diffusion a trouvé un terrain d'entente entre les modèles de diffusion et le forçage des enseignants : ils utilisent tous deux des programmes de formation qui impliquent de prédire les jetons masqués (bruyants) des jetons non masqués. Dans le cas des modèles de diffusion, ils ajoutent progressivement du bruit aux données, ce qui peut être considéré comme un masquage fractionnaire.

The MIT researchers' Diffusion Forcing method trains neural networks to cleanse a collection of tokens, removing different amounts of noise within each one while simultaneously predicting the next few tokens. The result: a flexible, reliable sequence model that resulted in higher-quality artificial videos and more precise decision-making for robots and AI agents.

La méthode Diffusion Forcing des chercheurs du MIT entraîne les réseaux neuronaux à nettoyer une collection de jetons, en supprimant différentes quantités de bruit au sein de chacun tout en prédisant simultanément les quelques jetons suivants. Le résultat : un modèle de séquence flexible et fiable qui a abouti à des vidéos artificielles de meilleure qualité et à une prise de décision plus précise pour les robots et les agents IA.

By sorting through noisy data and reliably predicting the next steps in a task, Diffusion Forcing can aid a robot in ignoring visual distractions to complete manipulation tasks. It can also generate stable and consistent video sequences and even guide an AI agent through digital mazes.

En triant les données bruitées et en prédisant de manière fiable les prochaines étapes d'une tâche, le forçage de diffusion peut aider un robot à ignorer les distractions visuelles pour effectuer des tâches de manipulation. Il peut également générer des séquences vidéo stables et cohérentes et même guider un agent IA à travers des labyrinthes numériques.

This method could potentially enable household and factory robots to generalize to new tasks and improve AI-generated entertainment.

Cette méthode pourrait potentiellement permettre aux robots domestiques et industriels de se généraliser à de nouvelles tâches et d’améliorer le divertissement généré par l’IA.

"Sequence models aim to condition on the known past and predict the unknown future, a type of binary masking. However, masking doesn't need to be binary," says lead author, MIT electrical engineering and computer science (EECS) Ph.D. student, and CSAIL member Boyuan Chen.

"Les modèles de séquence visent à conditionner le passé connu et à prédire l'avenir inconnu, un type de masquage binaire. Cependant, le masquage n'a pas besoin d'être binaire", explique l'auteur principal du doctorat en génie électrique et informatique du MIT (EECS). . étudiant et membre du CSAIL Boyuan Chen.

"With Diffusion Forcing, we add different levels of noise to each token, effectively serving as a type of fractional masking. At test time, our system can 'unmask' a collection of tokens and diffuse a sequence in the near future at a lower noise level. It knows what to trust within its data to overcome out-of-distribution inputs."

"Avec le forçage de diffusion, nous ajoutons différents niveaux de bruit à chaque jeton, servant ainsi efficacement de type de masquage fractionnaire. Au moment du test, notre système peut "démasquer" une collection de jetons et diffuser une séquence dans un avenir proche avec un bruit moindre. Il sait à quoi se fier dans ses données pour surmonter les entrées non distribuées.

In several experiments, Diffusion Forcing thrived at ignoring misleading data to execute tasks while anticipating future actions.

Dans plusieurs expériences, Diffusion Forcing a réussi à ignorer les données trompeuses pour exécuter des tâches tout en anticipant les actions futures.

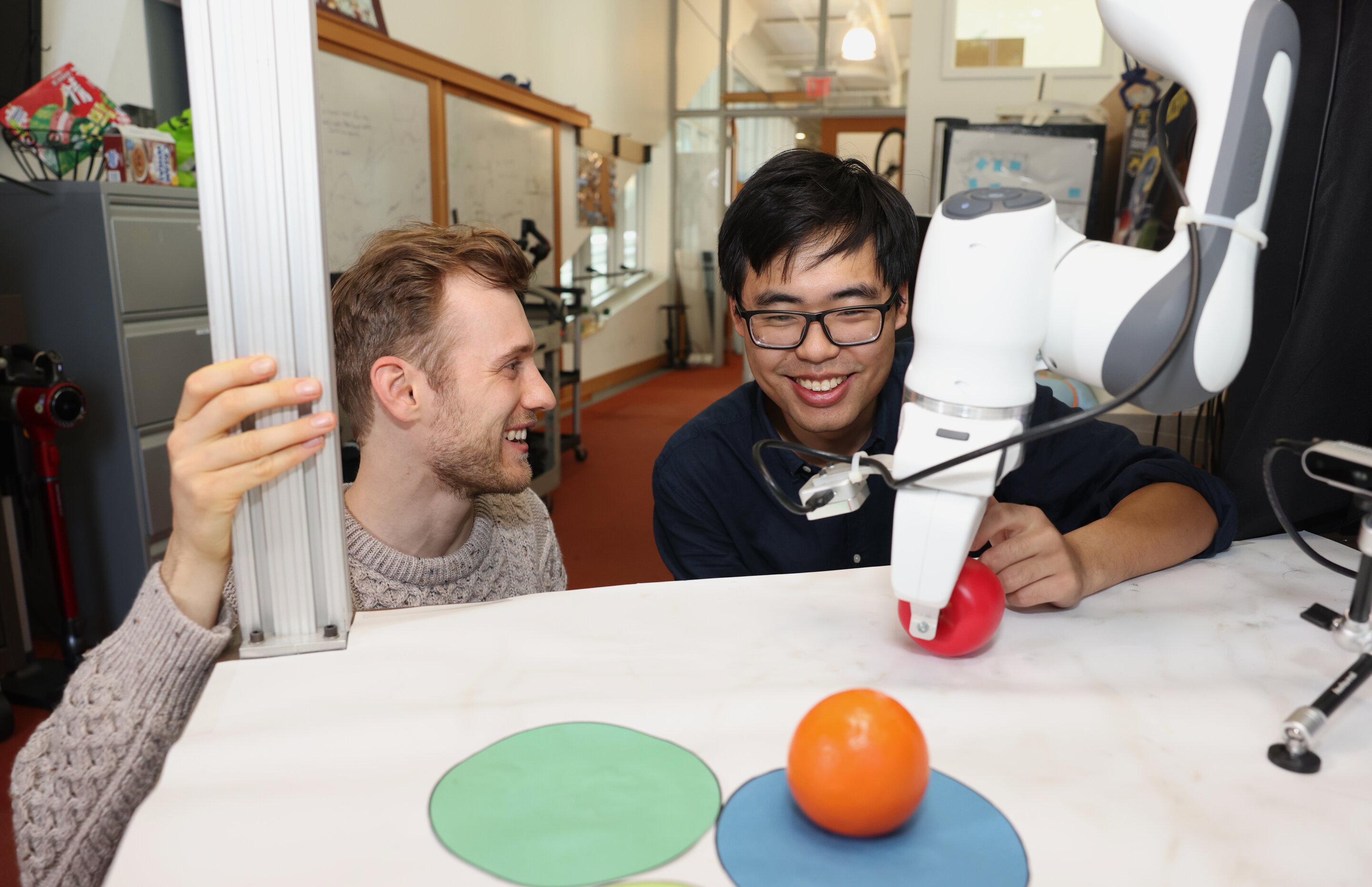

When implemented into a robotic arm, for example, it helped swap two toy fruits across three circular mats, a minimal example of a family of long-horizon tasks that require memories. The researchers trained the robot by controlling it from a distance (or teleoperating it) in virtual reality.

Lorsqu'il est mis en œuvre dans un bras robotique, par exemple, il permet d'échanger deux fruits jouets sur trois tapis circulaires, un exemple minimal d'une famille de tâches à long terme qui nécessitent des souvenirs. Les chercheurs ont entraîné le robot en le contrôlant à distance (ou en le téléopérant) en réalité virtuelle.

The robot is trained to mimic the user's movements from its camera. Despite starting from random positions and seeing distractions like a shopping bag blocking the markers, it placed the objects into its target spots.

Le robot est entraîné à imiter les mouvements de l'utilisateur depuis sa caméra. Bien qu'il soit parti de positions aléatoires et ait vu des distractions comme un sac de courses bloquant les marqueurs, il a placé les objets dans ses emplacements cibles.

To generate videos, they trained Diffusion Forcing on "Minecraft" game play and colorful digital environments created within Google's DeepMind Lab Simulator. When given a single frame of footage, the method produced more stable, higher-resolution videos than comparable baselines like a Sora-like full-sequence diffusion model and ChatGPT-like next-token models.

Pour générer des vidéos, ils ont formé Diffusion Forcing sur le jeu "Minecraft" et les environnements numériques colorés créés dans le DeepMind Lab Simulator de Google. Lorsqu'on lui donnait une seule image de séquence, la méthode produisait des vidéos plus stables et de plus haute résolution que des lignes de base comparables comme un modèle de diffusion en séquence complète de type Sora et des modèles de jeton suivant de type ChatGPT.

These approaches created videos that appeared inconsistent, with the latter sometimes failing to generate working video past just 72 frames.

Ces approches créaient des vidéos qui semblaient incohérentes, ces dernières ne parvenant parfois pas à générer une vidéo fonctionnelle au-delà de seulement 72 images.

Diffusion Forcing not only generates fancy videos, but can also serve as a motion planner that steers toward desired outcomes or rewards. Thanks to its flexibility, Diffusion Forcing can uniquely generate plans with varying horizon, perform tree search, and incorporate the intuition that the distant future is more uncertain than the near future.

Diffusion Forcing génère non seulement des vidéos sophistiquées, mais peut également servir de planificateur de mouvements qui oriente vers les résultats ou les récompenses souhaités. Grâce à sa flexibilité, Diffusion Forcing peut générer de manière unique des plans avec des horizons variables, effectuer une recherche arborescente et intégrer l'intuition que le futur lointain est plus incertain que le futur proche.

In the task of solving a 2D maze, Diffusion Forcing outperformed six baselines by generating faster plans leading to the goal location, indicating that it could be an effective planner for robots in the future.

Dans la tâche de résolution d'un labyrinthe 2D, le Diffusion Forcing a surpassé six lignes de base en générant des plans plus rapides menant à l'emplacement de l'objectif, indiquant qu'il pourrait être un planificateur efficace pour les robots à l'avenir.

Across each demo, Diffusion Forcing acted as a full sequence model, a next-token prediction model, or both. According to Chen, this versatile approach could potentially serve as a powerful backbone for a "world model," an AI system that can simulate the dynamics of the world by training on billions of internet videos.

Dans chaque démo, Diffusion Forcing a agi comme un modèle de séquence complète, un modèle de prédiction du jeton suivant, ou les deux. Selon Chen, cette approche polyvalente pourrait potentiellement servir de colonne vertébrale puissante pour un « modèle mondial », un système d'IA capable de simuler la dynamique du monde en s'entraînant sur des milliards de vidéos Internet.

This would allow robots

Cela permettrait aux robots

Clause de non-responsabilité:info@kdj.com

Les informations fournies ne constituent pas des conseils commerciaux. kdj.com n’assume aucune responsabilité pour les investissements effectués sur la base des informations fournies dans cet article. Les crypto-monnaies sont très volatiles et il est fortement recommandé d’investir avec prudence après une recherche approfondie!

Si vous pensez que le contenu utilisé sur ce site Web porte atteinte à vos droits d’auteur, veuillez nous contacter immédiatement (info@kdj.com) et nous le supprimerons dans les plus brefs délais.

-

-

- Hausse des prix du Bitcoin au milieu de la volatilité du marché de la cryptographie et du buzz réglementaire

- Feb 10, 2026 at 07:58 pm

- Les marchés du Bitcoin et de la cryptographie connaissent une évolution importante des prix, le Bitcoin approchant les 70 000 $, tandis que les discussions réglementaires et les nouveaux projets d'altcoin comme DeepSnitch AI attirent l'attention des investisseurs.

-

- Wintermute sonne l'alarme : la fuite de liquidité de l'IA fait vibrer Bitcoin au milieu d'un paysage cryptographique en évolution

- Feb 10, 2026 at 07:56 pm

- Wintermute prévient que l'IA siphonne les liquidités de la cryptographie, entraînant la volatilité du Bitcoin, mais le PDG de la société assure la résilience du marché contre les rumeurs d'effondrement.

-

- Le choc de la prison de Sam Bankman-Fried : les affirmations de FTX « jamais en faillite » ciblent les avocats dans la saga en cours

- Feb 10, 2026 at 07:49 pm

- Derrière les barreaux, Sam Bankman-Fried remue le pot, affirmant que FTX n'a jamais été en faillite et que les avocats ont poussé un dépôt prématuré au titre du chapitre 11, déclenchant un nouveau débat dans le monde de la cryptographie.

-

- L'engouement pour les pièces olympiques de 50p : les collectionneurs britanniques à la recherche d'une trouvaille rare

- Feb 10, 2026 at 07:15 pm

- Les collectionneurs britanniques sont enthousiasmés par une pièce olympique spécifique de 50 pence, le motif Football (Offside Rule), désormais considérée comme la plus rare de la série et un incontournable pour les passionnés.

-

- Grands livres CEX sous surveillance : 2000 BTC Glitch et la question fondamentale de la confiance

- Feb 10, 2026 at 06:52 pm

- Une erreur BTC massive sur Bithumb et le dépôt de 2 000 BTC d'une baleine mettent en évidence les problèmes de confiance fondamentaux inhérents aux registres de change centralisés, révélant les risques systémiques et la volatilité du marché.

-

- Le prix du Bitcoin stagne au milieu d’achats institutionnels stables : un marché en consolidation

- Feb 10, 2026 at 06:50 pm

- Le prix du Bitcoin navigue dans un mouvement latéral, soutenu par les afflux d'ETF institutionnels et un plancher solide de 60 000 $, alors que les marchés attendent une clarté réglementaire.

-

- L'espresso réchauffe Binance : le trading avant commercialisation signale une nouvelle ère pour la couche 2

- Feb 10, 2026 at 06:42 pm

- Espresso (ESP) suscite un intérêt considérable avec ses débuts en pré-commercialisation sur Binance, soulignant l'attention croissante accordée aux jetons d'infrastructure Ethereum Layer-2 et l'évolution dynamique du trading de crypto-monnaies.

-