|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

지난 몇 년 동안 등장한 획기적인 인공 지능(AI) 애플리케이션 중 상당수는 시퀀스 모델이라는 광범위한 알고리즘 카테고리 덕분에 성공을 거두었습니다.

Sequence models have played a crucial role in the development of several groundbreaking artificial intelligence (AI) applications in recent years. For instance, the algorithms that power popular large language models like Llama, ChatGPT, and Gemini belong to a specific category of sequence models that perform next-token (or word) prediction.

시퀀스 모델은 최근 몇 년간 획기적인 인공 지능(AI) 애플리케이션 개발에 중요한 역할을 해왔습니다. 예를 들어 Llama, ChatGPT 및 Gemini와 같은 널리 사용되는 대규모 언어 모델을 지원하는 알고리즘은 다음 토큰(또는 단어) 예측을 수행하는 특정 범주의 시퀀스 모델에 속합니다.

Text-to-video tools, such as Sora, are also based on sequence models, but in these cases the models used can predict the full sequence of a result, not just the next token.

Sora와 같은 텍스트-비디오 도구도 시퀀스 모델을 기반으로 하지만 이러한 경우 사용된 모델은 다음 토큰뿐만 아니라 결과의 전체 시퀀스를 예측할 수 있습니다.

Traditionally, sequence models built for next-token prediction can generate sequences of variable lengths but struggle with long-term planning. On the other hand, full-sequence models excel at long-term planning but are limited to fixed-length input and output sequences. This leaves both classes of models with their own set of trade-offs, each leaving something different to be desired.

전통적으로 다음 토큰 예측을 위해 구축된 시퀀스 모델은 가변 길이의 시퀀스를 생성할 수 있지만 장기 계획에 어려움을 겪습니다. 반면, 전체 시퀀스 모델은 장기 계획에 탁월하지만 고정 길이 입력 및 출력 시퀀스로 제한됩니다. 이로 인해 두 가지 클래스의 모델 모두 고유한 절충안 세트가 있으며 각각 원하는 것이 서로 다릅니다.

Researchers at MIT CSAIL and the Technical University of Munich have proposed a novel approach called Diffusion Forcing to combine the strengths of both next-token and full-sequence models. This technique improves both the quality and adaptability of sequence models.

MIT CSAIL과 뮌헨 기술 대학의 연구원들은 다음 토큰과 전체 시퀀스 모델의 장점을 결합하기 위해 확산 강제라는 새로운 접근 방식을 제안했습니다. 이 기술은 시퀀스 모델의 품질과 적응성을 모두 향상시킵니다.

At its core, Diffusion Forcing builds on "Teacher Forcing," which simplifies sequence generation into smaller, manageable steps by predicting one token at a time. Diffusion Forcing introduces the concept of "fractional masking," where noise is added to the data in varying amounts, mimicking the process of partially obscuring or masking tokens. The model is then trained to remove this noise and predict the next few tokens, allowing it to simultaneously handle denoising and future predictions. This method makes the model highly adaptable to tasks involving noisy or incomplete data, enabling it to generate precise, stable outputs.

기본적으로 Diffusion Forcing은 한 번에 하나의 토큰을 예측하여 시퀀스 생성을 더 작고 관리 가능한 단계로 단순화하는 "Teacher Forcing"을 기반으로 합니다. 확산 강제는 토큰을 부분적으로 가리거나 마스킹하는 프로세스를 모방하여 다양한 양으로 데이터에 노이즈를 추가하는 "부분 마스킹" 개념을 도입합니다. 그런 다음 모델은 이 노이즈를 제거하고 다음 몇 개의 토큰을 예측하도록 훈련되어 노이즈 제거와 향후 예측을 동시에 처리할 수 있습니다. 이 방법을 사용하면 모델이 잡음이 많거나 불완전한 데이터와 관련된 작업에 고도로 적응할 수 있어 정확하고 안정적인 출력을 생성할 수 있습니다.

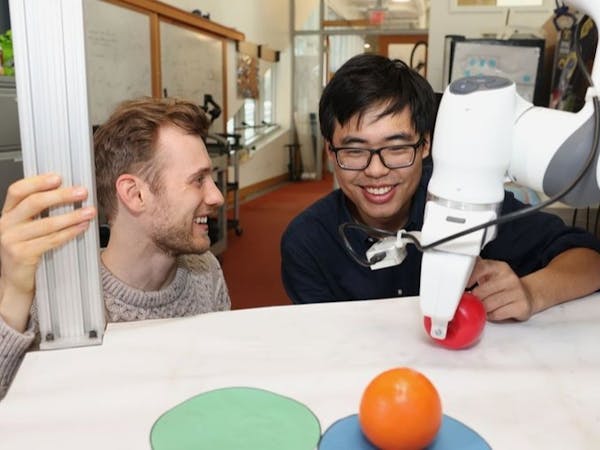

The researchers validated the Diffusion Forcing technique through a series of experiments in robotics and video generation. In one experiment, the team applied the method to a robotic arm tasked with swapping two toy fruits across three circular mats. Despite visual distractions like a shopping bag obstructing its view, the robotic arm successfully completed the task, demonstrating Diffusion Forcing’s ability to filter out noisy data and make reliable decisions.

연구원들은 로봇 공학 및 비디오 생성에 대한 일련의 실험을 통해 확산 강제 기술을 검증했습니다. 한 실험에서 팀은 세 개의 원형 매트에 걸쳐 두 개의 장난감 과일을 교환하는 임무를 맡은 로봇 팔에 이 방법을 적용했습니다. 시야를 가리는 쇼핑백과 같은 시각적 방해에도 불구하고 로봇 팔은 작업을 성공적으로 완료하여 시끄러운 데이터를 필터링하고 신뢰할 수 있는 결정을 내리는 Diffusion Forcing의 능력을 입증했습니다.

In another set of experiments, Diffusion Forcing was tested in video generation, where it was trained on gameplay footage from Minecraft and simulated environments in Google’s DeepMind Lab. Compared to traditional diffusion models and next-token models, Diffusion Forcing produced higher-resolution and more stable videos from single frames, even outperforming baselines that struggled to maintain coherence beyond 72 frames.

또 다른 실험 세트에서는 비디오 생성에서 확산 강제를 테스트했으며, 여기서는 Minecraft의 게임 플레이 영상과 Google DeepMind Lab의 시뮬레이션 환경을 대상으로 훈련을 받았습니다. 기존 확산 모델 및 차세대 토큰 모델과 비교하여 Diffusion Forcing은 단일 프레임에서 더 높은 해상도와 더 안정적인 비디오를 생성했으며, 심지어 72프레임 이상으로 일관성을 유지하기 위해 애쓰는 기준선보다 뛰어난 성능을 보였습니다.

Finally, in a maze-solving task, the method generated faster and more accurate plans than six baseline models, showcasing its potential for long-horizon tasks like motion planning in robotics.

마지막으로 미로 해결 작업에서 이 방법은 6개의 기본 모델보다 더 빠르고 정확한 계획을 생성하여 로봇 공학의 동작 계획과 같은 장거리 작업에 대한 잠재력을 보여주었습니다.

Overall, Diffusion Forcing provides a flexible framework for both long-term planning and variable-length sequence generation, making it valuable in diverse fields such as robotics, video generation, and AI planning. The technique's ability to handle uncertainty and adapt to new inputs could ultimately lead to advancements in how robots learn and perform complex tasks in unpredictable environments.

전반적으로 Diffusion Forcing은 장기 계획과 가변 길이 시퀀스 생성을 위한 유연한 프레임워크를 제공하므로 로봇 공학, 비디오 생성 및 AI 계획과 같은 다양한 분야에서 가치가 있습니다. 불확실성을 처리하고 새로운 입력에 적응하는 이 기술의 능력은 궁극적으로 로봇이 예측할 수 없는 환경에서 복잡한 작업을 학습하고 수행하는 방법을 발전시킬 수 있습니다.

부인 성명:info@kdj.com

제공된 정보는 거래 조언이 아닙니다. kdj.com은 이 기사에 제공된 정보를 기반으로 이루어진 투자에 대해 어떠한 책임도 지지 않습니다. 암호화폐는 변동성이 매우 높으므로 철저한 조사 후 신중하게 투자하는 것이 좋습니다!

본 웹사이트에 사용된 내용이 귀하의 저작권을 침해한다고 판단되는 경우, 즉시 당사(info@kdj.com)로 연락주시면 즉시 삭제하도록 하겠습니다.

![Bittensor [TAO] 가격 예측: 강세 전망은 $500에서 잠재적 반등 신호를 나타냄 Bittensor [TAO] 가격 예측: 강세 전망은 $500에서 잠재적 반등 신호를 나타냄](/uploads/2024/10/23/cryptocurrencies-news/articles/bittensor-tao-price-prediction-bullish-outlook-signals-potential-bounce-support/image-1.jpg)